Обратное распространение ошибки — различия между версиями

Xroms (обсуждение | вклад) |

Xroms (обсуждение | вклад) (→Обучение как задача оптимизации) |

||

| Строка 5: | Строка 5: | ||

]] | ]] | ||

| − | Изначально | + | Изначально веса задаются случайно. Затем, нейрон обучается с помощью тренировочного множества, которое в этом случае состоит из множества троек <math>(x_1, x_2, t)</math> где <math>x_1</math> и <math>x_2</math> {{---}} это входные данные сети и <math>t</math> {{---}} правильный ответ. Начальная сеть, приняв на вход <math>x_1</math> и <math>x_2</math>, вычислит ответ <math>y</math>, который вероятно отличается от <math>t</math>. Общепринятый метод вычисления несоответствия между ожидаемым <math>t</math> и получившимся <math>y</math> ответом {{---}} квадратичная функция потерь: |

:<math>E=(t-y)^2, </math> где <math>E</math> ошибка. | :<math>E=(t-y)^2, </math> где <math>E</math> ошибка. | ||

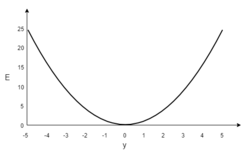

В качестве примера, рассмотрим сеть с одним тренировочным объектом: <math>(1, 1, 0)</math>, таким образом, значения <math>x_1</math> и <math>x_2</math> равны 1, а <math>t</math> равна 0. Теперь, если действительный ответ <math>y</math> изобразить на графике на горизонтальной оси, а ошибку <math>E</math> на вертикальной, результатом будет парабола. Минимум параболы соответствует ответу <math>y</math>, который минимизирует ошибку <math>E</math>. Для одиночного тренировочного объекта, минимум также касается горизонтальной оси, следовательно ошибка будет нулевая и сеть может выдать ответ <math>y</math> который точно соответствует ожидаемому ответу <math>t</math>. Следовательно, задача преобразования входных значений в выходные может быть сведена к задаче оптимизации, заключающейся в поиске функции, которая даст минимальную ошибку. [[File:Error surface of a linear neuron for a single training case.png|right|thumb|250px|График ошибки для нейрона с линейной функцией активации и одним тренировочным объектом]] | В качестве примера, рассмотрим сеть с одним тренировочным объектом: <math>(1, 1, 0)</math>, таким образом, значения <math>x_1</math> и <math>x_2</math> равны 1, а <math>t</math> равна 0. Теперь, если действительный ответ <math>y</math> изобразить на графике на горизонтальной оси, а ошибку <math>E</math> на вертикальной, результатом будет парабола. Минимум параболы соответствует ответу <math>y</math>, который минимизирует ошибку <math>E</math>. Для одиночного тренировочного объекта, минимум также касается горизонтальной оси, следовательно ошибка будет нулевая и сеть может выдать ответ <math>y</math> который точно соответствует ожидаемому ответу <math>t</math>. Следовательно, задача преобразования входных значений в выходные может быть сведена к задаче оптимизации, заключающейся в поиске функции, которая даст минимальную ошибку. [[File:Error surface of a linear neuron for a single training case.png|right|thumb|250px|График ошибки для нейрона с линейной функцией активации и одним тренировочным объектом]] | ||

| − | В таком случае, выходное значение нейрона | + | В таком случае, выходное значение нейрона {{---}} взвешенная сумма всех его входных значений: |

:<math>y=x_1w_1 + x_2w_2,</math> | :<math>y=x_1w_1 + x_2w_2,</math> | ||

| − | где <math>w_1</math> и <math>w_2</math> {{---}} веса на ребрах, соединяющих входные вершины с выходной. Следовательно, ошибка зависит от весов, входящих в нейрон. И именно это нужно менять в процессе обучения. Распространенный алгоритм для поиска набора весов, минимизирующего ошибку | + | где <math>w_1</math> и <math>w_2</math> {{---}} веса на ребрах, соединяющих входные вершины с выходной. Следовательно, ошибка зависит от весов, входящих в нейрон. И именно это нужно менять в процессе обучения. Распространенный алгоритм для поиска набора весов, минимизирующего ошибку {{---}} градиентный спуск. Метод обратного распространения ошибки используется для вычисления самого "крутого" направления для спуска. |

==Дифференцирование для однослойной сети== | ==Дифференцирование для однослойной сети== | ||

Версия 06:14, 5 апреля 2019

Метод обратного распространения ошибок (англ. backpropagation) — метод вычисления градиента, который используется при обновлении весов в нейронной сети.

Содержание

Обучение как задача оптимизации

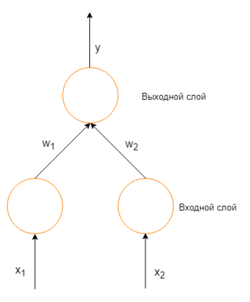

Чтобы понять математическое предназначение метода, требуется осознать взаимоотношения между действительными выходными значениями сети и требуемыми выходными значениями для конкретного примера из обучения. Рассмотрим простую нейронную сеть без скрытых слоев, с двумя входными вершинами и одной выходной, в которых каждый нейрон использует линейную функцию активации,[заметка 1] которая является взвешенной суммой входных данных.Изначально веса задаются случайно. Затем, нейрон обучается с помощью тренировочного множества, которое в этом случае состоит из множества троек где и — это входные данные сети и — правильный ответ. Начальная сеть, приняв на вход и , вычислит ответ , который вероятно отличается от . Общепринятый метод вычисления несоответствия между ожидаемым и получившимся ответом — квадратичная функция потерь:

- где ошибка.

В таком случае, выходное значение нейрона — взвешенная сумма всех его входных значений:

где и — веса на ребрах, соединяющих входные вершины с выходной. Следовательно, ошибка зависит от весов, входящих в нейрон. И именно это нужно менять в процессе обучения. Распространенный алгоритм для поиска набора весов, минимизирующего ошибку — градиентный спуск. Метод обратного распространения ошибки используется для вычисления самого "крутого" направления для спуска.

Дифференцирование для однослойной сети

Метод градиентного спуска включает в себя вычисление дифференциала квадратичной функции ошибки относительно весов сети. Обычно это делается с помощью метода обратного распространения ошибки. Предположим, что выходной нейрон один,[заметка 2] тогда квадратичная функция ошибки:

- где — квадратичная ошибка, — требуемый ответ для обучающего образца, — действительный ответ сети.

Множитель добавлен чтобы предотвратить возникновение экспоненты во время дифференцирования. Позже, выражение будет умножено на произвольную величину скорости обучения, так что не имеет значения на какую константу мы умножим сейчас.

Для каждого нейрона , его выходное значение определено как

Входные значения нейрона это взвешенная сумма выходных значений предыдущих нейронов. Если нейрон в первом слове после входного слоя, то входного слоя это просто входные значения сети. Количество входных значений нейрона . Переменная обозначает вес на ребре между нейроном предыдущего слоя и нейроном текущего слоя.

Функция активации нелинейна и дифференцируема. Одна из распространенных функций активации — сигмоида:

у нее удобная производная:

Находим производную ошибки

Вычисление частной производной ошибки по весам выполняется с помощью цепного правила:

Только одно слагаемое в зависит от , так что

Если нейрон в первом слое после входного, то это просто .

Производная выходного значения нейрона по его входному значению это просто частная производная функции активации (предполагается что в качестве функции активации используется сигмоида):

По этой причине данный метод требует дифференцируемой функции активации. (Тем не менее, функция ReLU стала достаточно популярной в последнее время, хоть и не дифференцируема в 0)

Первый множитель легко вычислим, если нейрон находится в выходном слое, ведь в таком случае и

Тем не менее, если произвольный внутренний слой сети, нахождение производной по менее очевидно.

Если рассмотреть как функцию, берущую на вход все нейроны получающие на вход значение нейрона ,

и взять полную производную по , то получим рекурсивное выражение для производной:

Следовательно, производная по может быть вычислена если все все производные по выходным значениям следующего слоя известны.

Если собрать все месте:

и

Чтобы обновить вес используя градиентный спуск, нужно выбрать скорость обучения, . Изменение в весах должно отражать влияние на увеличение или уменьшение в . Если , увеличение увеличивает ; наоборот, если , увеличение уменьшает . Новый добавлен к старым весам, и произведение скорости обучения на градиент, умноженный на гарантирует что изменения будут всегда уменьшать . Другими словами, в следующем уравнении, всегда изменяет в такую сторону, что уменьшается:

Недостатки алгоритма

Несмотря на многочисленные успешные применения обратного распространения, оно не является универсальным решением. Больше всего неприятностей приносит неопределённо долгий процесс обучения. В сложных задачах для обучения сети могут потребоваться дни или даже недели, она может и вообще не обучиться. Причиной может быть одна из описанных ниже.

Паралич сети

В процессе обучения сети значения весов могут в результате коррекции стать очень большими величинами. Это может привести к тому, что все или большинство нейронов будут функционировать при очень больших значениях OUT, в области, где производная сжимающей функции очень мала. Так как посылаемая обратно в процессе обучения ошибка пропорциональна этой производной, то процесс обучения может практически замереть.

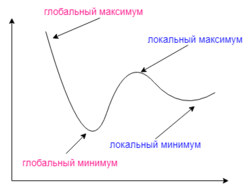

Локальные минимумы

Градиентный спуск с обратным распространением ошибок гарантирует нахождение только локального минимума функции; также, возникают проблемы с пересечением плато на поверхности функции ошибки.

Алгоритм

Алгоритм: BackPropagation

- Инициализировать маленькими случайными значениями,

- Повторить раз:

- .Для всех d от 1 до m:

- Подать на вход сети и подсчитать выходы каждого узла.

- Для всех

- .

- Для каждого уровня l, начиная с предпоследнего:

- Для каждого узла j уровня l вычислить

- .

- Для каждого ребра сети {i, j}

- .

- .

- Выдать значения .

где — коэффициент инерциальности для сглаживания резких скачков при перемещении по поверхности целевой функции