Регуляризация — различия между версиями

(→Мотивация) |

(→Мотивация) |

||

| Строка 5: | Строка 5: | ||

==Мотивация== | ==Мотивация== | ||

| − | Как говорилось ранее, регуляризация полезна для борьбы с | + | Как говорилось ранее, регуляризация полезна для борьбы с [[Переобучение | переобучением]]. Если вы выбрали сложную модель, и при этом у вас недостаточно данных, то легко можно получить итоговую модель, которая хорошо описывает обучающую выборку, но не обобщается на тестовую. |

| + | |||

| + | ===На примере [[Линейная регрессия | линейной регрессии]]=== | ||

В качестве наглядного примера можно рассмотреть линейные регрессионные модели. | В качестве наглядного примера можно рассмотреть линейные регрессионные модели. | ||

| Строка 19: | Строка 21: | ||

Одним из способов бороться с этим эффектом - использовать регуляризацию, т. е. добавлять некоторый штраф за большие значения коэффициентов у модели. Тем самым мы запретим слишком "резкие" изгибы и ограничим возможность подстраивания модели под данные. | Одним из способов бороться с этим эффектом - использовать регуляризацию, т. е. добавлять некоторый штраф за большие значения коэффициентов у модели. Тем самым мы запретим слишком "резкие" изгибы и ограничим возможность подстраивания модели под данные. | ||

| + | |||

| + | ===На примере [[Логистическая регрессия | логистической регрессии]]=== | ||

| + | |||

| + | Необходимость регуляризации можно увидеть и на другом примере. Представьте, что ваша обучающая выборка была линейно разделима. В таком случае в процессе оптимизации значения весов уйдут в бесконечность и вместо сигмойды получится "ступенька", как представлено на Рис. 3. | ||

| + | |||

| + | {|align="center" | ||

| + | |-valign="top" | ||

| + | |[[Файл:Sigmoid_infinity_weights.png|300px|thumb|Рис 3. Сигмойда - "ступенька"]] | ||

| + | |} | ||

| + | |||

| + | Это плохо, ибо мы переобучились на нашу обучающую выборку. Как и в предыдущем примере, побороться с этим можно путем добавлением регуляризации, не дающей весам принимать слишком большие значения. | ||

==Основные виды регуляризации== | ==Основные виды регуляризации== | ||

Версия 04:02, 19 января 2020

| Определение: |

| Регуляризация (англ. regularization) в статистике, машинном обучении, теории обратных задач — метод добавления некоторых дополнительных ограничений к условию с целью решить неккоректно поставленную задачу или предотвратить переобучение. Чаще всего эта информация имеет вид штрафа за сложность модели. |

Содержание

Мотивация

Как говорилось ранее, регуляризация полезна для борьбы с переобучением. Если вы выбрали сложную модель, и при этом у вас недостаточно данных, то легко можно получить итоговую модель, которая хорошо описывает обучающую выборку, но не обобщается на тестовую.

На примере линейной регрессии

В качестве наглядного примера можно рассмотреть линейные регрессионные модели. Восстановить зависимость для нескольких точек можно пытаться полиномами разной степени M.

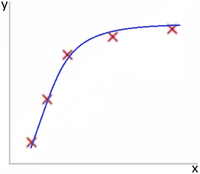

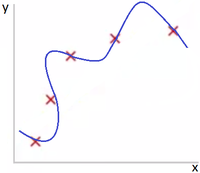

Как можно видеть на Рис 1. представлена зависимость, которая хорошо подходит для описания данных, а на Рис. 2 - модель слишком сильно заточилась под обучающую выборку.

Одним из способов бороться с этим эффектом - использовать регуляризацию, т. е. добавлять некоторый штраф за большие значения коэффициентов у модели. Тем самым мы запретим слишком "резкие" изгибы и ограничим возможность подстраивания модели под данные.

На примере логистической регрессии

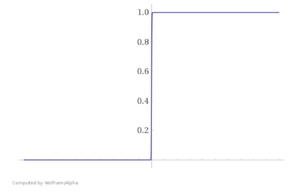

Необходимость регуляризации можно увидеть и на другом примере. Представьте, что ваша обучающая выборка была линейно разделима. В таком случае в процессе оптимизации значения весов уйдут в бесконечность и вместо сигмойды получится "ступенька", как представлено на Рис. 3.

Это плохо, ибо мы переобучились на нашу обучающую выборку. Как и в предыдущем примере, побороться с этим можно путем добавлением регуляризации, не дающей весам принимать слишком большие значения.