Выброс — различия между версиями

Fest (обсуждение | вклад) (→Виды выбросов) |

Fest (обсуждение | вклад) (→Виды выбросов) |

||

| Строка 6: | Строка 6: | ||

===Виды выбросов=== | ===Виды выбросов=== | ||

Выбросы могут быть двух видов: одномерные и многомерные. Одномерные выбросы можно найти при рассмотрении распределения значений объектов в одном пространстве. Многомерные выбросы можно найти в n-мерном пространстве (из n-объектов). Рассмотрение распределений в n-мерных пространствах может быть очень сложным для человеческого мозга, поэтому необходимо обучить модель, чтобы сделать это. | Выбросы могут быть двух видов: одномерные и многомерные. Одномерные выбросы можно найти при рассмотрении распределения значений объектов в одном пространстве. Многомерные выбросы можно найти в n-мерном пространстве (из n-объектов). Рассмотрение распределений в n-мерных пространствах может быть очень сложным для человеческого мозга, поэтому необходимо обучить модель, чтобы сделать это. | ||

| + | <br> | ||

Выбросы могут также отличаться в зависимости от окружающей среды: точечные выбросы, контекстуальные выбросы или коллективные выбросы. Точечные выбросы - это единичные точки данных, расположенные далеко от остальной части распределения. Контекстные выбросы могут представлять собой шум в данных, например, знаки препинания при выполнении анализа текста или сигнал фонового шума при распознавании речи. Коллективные выбросы могут быть подмножествами новшеств в данных, таких как сигнал, который может указывать на открытие новых явлений. | Выбросы могут также отличаться в зависимости от окружающей среды: точечные выбросы, контекстуальные выбросы или коллективные выбросы. Точечные выбросы - это единичные точки данных, расположенные далеко от остальной части распределения. Контекстные выбросы могут представлять собой шум в данных, например, знаки препинания при выполнении анализа текста или сигнал фонового шума при распознавании речи. Коллективные выбросы могут быть подмножествами новшеств в данных, таких как сигнал, который может указывать на открытие новых явлений. | ||

Версия 15:55, 24 января 2019

Выброс(англ. outlier) — небольшая доля объектов во входных данных, которая сильно выделяется из общей выборки. Многие алгоритмы машинного обучения чувствительны к разбросу и распределению значений атрибутов во входных данных. Соответственно выбросы во входных данных могут исказить и ввести в заблуждение процесс обучения алгоритмов машинного обучения, что приводит к увеличению времени обучения, снижению точности моделей и, в конечном итоге, к снижению результатов. Даже до подготовки предсказательных моделей на основе обучающих данных выбросы могут приводить к ошибочным представлениям и в дальнейшем к ошибочной интерпретации собранных данных.

Содержание

Виды выбросов

Выбросы могут быть двух видов: одномерные и многомерные. Одномерные выбросы можно найти при рассмотрении распределения значений объектов в одном пространстве. Многомерные выбросы можно найти в n-мерном пространстве (из n-объектов). Рассмотрение распределений в n-мерных пространствах может быть очень сложным для человеческого мозга, поэтому необходимо обучить модель, чтобы сделать это.

Выбросы могут также отличаться в зависимости от окружающей среды: точечные выбросы, контекстуальные выбросы или коллективные выбросы. Точечные выбросы - это единичные точки данных, расположенные далеко от остальной части распределения. Контекстные выбросы могут представлять собой шум в данных, например, знаки препинания при выполнении анализа текста или сигнал фонового шума при распознавании речи. Коллективные выбросы могут быть подмножествами новшеств в данных, таких как сигнал, который может указывать на открытие новых явлений.

Причины возникновения выбросов

- Сбой работы оборудования

- Человеческий фактор

- Случайность

- Уникальные явления

- и др.

Примеры

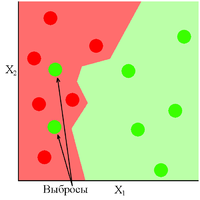

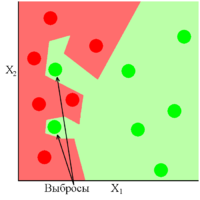

Рис 2 показывает хорошо обученную модель, в которой присутствуют два выброса. Как видно из рисунка данная модель показала себя устойчивой к выбросам, либо же вовремя прекратила своё обучение. Обратная ситуация обстоит с Рис 3, где модель сильно переобучилась из-за присутствующих в ней выбросов.

Методы обнаружения и борьбы с выбросами

Методы обнаружения выбросов

- Экстремальный анализ данных(англ. extreme value analysis). При таком анализе не применяются какие-либо специальные статистические методы. Обычно этот метод применим для одномерного случая. Алгоритм использования таков:

- Визуализировать данные, используя диаграммы и гистограммы для нахождения экстремальных значений.

- Задействовать распределение, например Гауссовское, и найти значения, чье стандартное отклонение отличается в 2-3 раза от математического ожидания или в полтора раза от первой либо третьей квартилей.

- Отфильтровать предполагаемые выбросы из обучающей выборки и оценить работу модели.

- Апроксимирующий метод (англ. proximity method). Чуть более сложный метод, заключающийся в применении кластеризующих методов.

- Использовать метод кластеризации для определения кластеров для данных.

- Идентифицировать и отметить центроиды каждого кластера.

- Соотнести кластеры с экземплярами данных, находящимися на фиксированном расстоянии или на процентном удалении от центроиды соответствующего кластера.

- Отфильтровать предполагаемые выбросы из обучающей выборки и оценить работу модели.

- Проецирующие методы (англ. projections methods). Эти методы довольно быстро и просто определяют выбросы в выборке.

- Использовать один из проецирующих методов, например метод главных компонент (англ. principal component analysis, PCA[1]) или самоорганизующиеся карты Кохонена(англ. self-organizing map, SOM[2]) или проекцию Саммона(англ. Sammon mapping, Sammon projection[3]), для суммирования обучающих данных в двух измерениях.

- Визуализировать отображение

- Использовать критерий близости от проецируемых значений или от вектора таблицы кодирования (англ. codebook vector) для идентифицирования выбросов.

- Отфильтровать предполагаемые выбросы из обучающей выборки и оценить работу модели.

Алгоритмы борьбы с выбросами

- Локально взвешенное сглаживание(англ. LOcally WEighted Scatter plot Smoothing, LOWESS)[4].

ВХОД: (-) обучающая выборка; ВЫХОД: коэффиценты ; ________________________________________________________ 1: инициализация: ; 2: повторять 3: для всех объектов ; 4: вычислить оценки скользящего контроля: 5: для всех объектов ; 6: 7: пока коэффиценты не стабилизируются;

Пример. Допустим мы пытаемся восстановить зависимость, используя формулу Надарая-Ватсона[5] по некоторым данным из n наблюдений, 2 из которых имеют излишне высокое и излишне низкое значения соответственно. Большие ошибки, вызванные этими выбросами, довольно заметно исказят полученный результат по формуле. В методе локально взвешенного сглаживания мы домножаем веса объектов на коэффиценты , значения которых тем меньше, чем величина ошибки . Для этого мы возьмём квартическое ядро (не обязательно совпадающее с основным ядром) , где — медиана множества значений . Таким образом выбросы будут нивелироваться автоматически при использовании данного подхода. В статистике методы, устойчивые к нарушениям модельных предположений о данных, называются робастными. Метод локально взвешенного сглаживания относится к робастным методам, так как он устойчив к наличию небольшого количества выбросов.

- Дерево принятия решения (англ. decision tree[6]). Это дерево, как и уже описанный алгоритм локально взвешенного сглаживания, относится робастным методам.