Виды ансамблей

Ансамбль

Рассмотрим задачу классификации на K классов:

Пусть имеется M классификатор ("экспертов"):

Тогда давайте посмотрим новый классификатор на основе данных:

Простое голосование:

Взвешенное голосование:

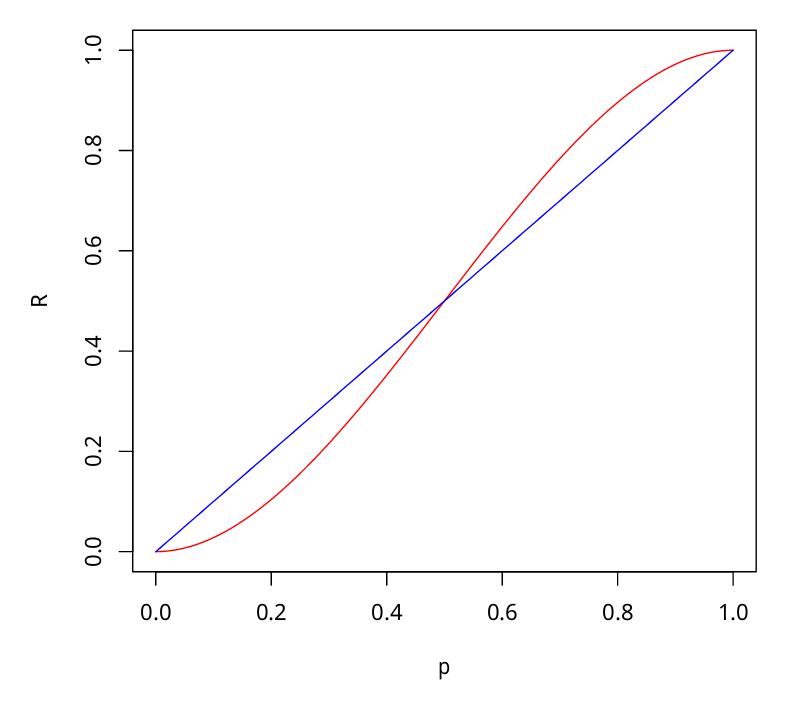

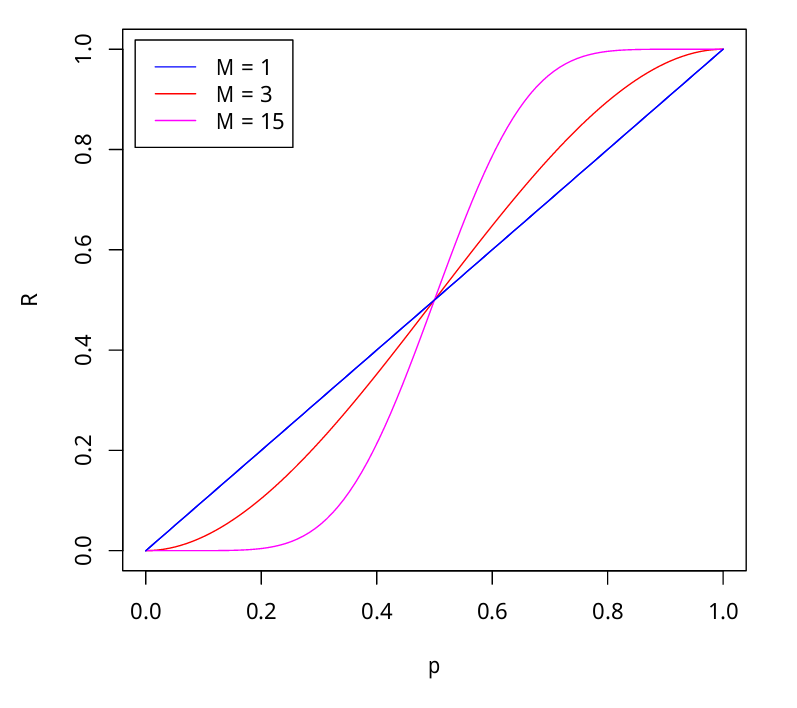

Вероятность ошибки

Пусть - количество присяжный, - вероятность правильного решения одного эксперта, - вероятность правильного решения всего жюри, - минимальное большинство членов жюри

Тогда

Бутстрэп

Метод бутстрэпа (англ. bootstrap) — один из первых и самых простых видов ансамблей, который позволяет оценивать многие статистики сложных распределений и заключается в следующем. Пусть имеется выборка размера . Равномерно возьмем из выборки объектов с возвращением. Это означает, что мы будем раз равновероятно выбирать произвольный объект выборки, причем каждый раз мы выбираем из всех исходных объектов. Отметим, что из-за возвращения среди них окажутся повторы.

Обозначим новую выборку через . Повторяя процедуру раз, сгенерируем подвыборок . Теперь мы имеем достаточно большое число выборок и можем оценивать различные статистики исходного распределения.

Бутсреп используется в статистике, в том числе для:

- Аппроксимация стандартной ошибки выборочной оценки

- Байесовская коррекция с помощью бутстреп метода

- Доверительные интервалы

- Метод процентилей

Бэггинг

Пусть имеется выборка размера . Количество классификаторов

Алгоритм классификации в технологии бэггинг на подпространствах:

- Генерируется с помощью бутстрэпа M выборок размера N для каждого классификатора

- Производится независимое обучения каждого элементарного классификатора (каждого алгоритма, определенного на своем подпространстве).

- Производится классификация основной выборки на каждом из подпространств (также независимо).

- Принимается окончательное решение о принадлежности объекта одному из классов. Это можно сделать несколькими разными способами, подробнее описано ниже.

Окончательное решение о принадлежности объекта классу может приниматься, например, одним из следующих методов:

- Консенсус: если все элементарные классификаторы присвоили объекту одну и ту же метку, то относим объект к выбранному классу.

- Простое большинство: консенсус достижим очень редко, поэтому чаще всего используют метод простого большинства. Здесь объекту присваивается метка того класса, который определило для него большинство элементарных классификаторов.

- Взвешивание классификаторов: если классификаторов четное количество, то голосов может получиться поровну, еще возможно, что для эксперты одна из групп параметров важна в большей степени, тогда прибегают к взвешиванию классификаторов. То есть при голосовании голос классификатора умножается на его вес.

Эффективность

Рассмотрим задачу регрессии с базовыми алгоритмами . Предположим, что существует истинная функция ответа для всех объектов y(x), а также задано распределение p(x) на объектах. В этом случае мы можем записать ошибку каждой функции регрессии:

и записать матожидание среднеквадратичной ошибки:

Средняя ошибка построенных функций регрессии имеет вид:

Предположим, что ошибки несмещены и некоррелированы:

Построим теперь новую функцию регрессии, которая будет усреднять ответы построенных нами функций:

Найдем ее среднеквадратичную ошибку:

Таким образом, усреднение ответов позволило уменьшить средний квадрат ошибки в раз