Neural Style Transfer

Содержание

Описание алгоритма

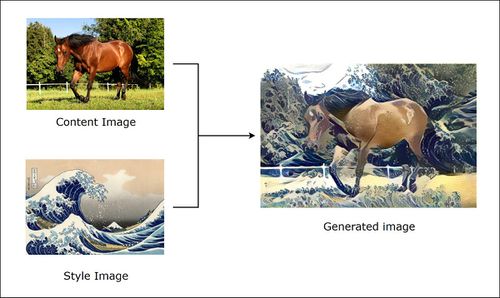

Алгоритм нейронного переноса стиля (англ. Neural Style Transfer), разработанный Леоном Гатисом, Александром Экером и Матиасом Бетге, позволяет получить изображение и воспроизводить его в новом художественном стиле. Алгоритм берет три изображения, входное изображение (англ. input image), изображение контента (англ. content image) и изображение стиля (англ. style image), и изменяет входные данные так, чтобы они соответствовали содержанию изображения контента и художественному стилю изображения стиля. Авторами в качестве модели сверточной нейронной сети предлагается использовать сеть VGG16.

Принцип работы алгоритма

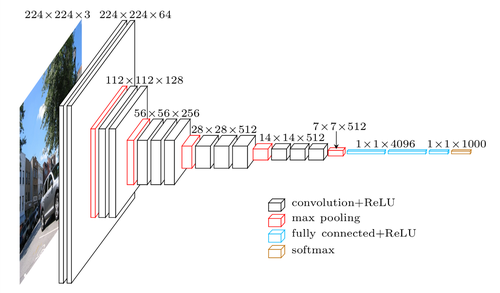

Рассмотрим 1-й сверточный слой (англ. convolution layer) VGG16, который использует ядро 3x3 и обучает 64 карты признаков (англ. feature map) для генерации представления изображения размерности 224x224x64, принимая 3-канальное изображение размером 224x224 в качестве входных данных (Рисунок 3). Во время обучения эти карты признаков научились обнаруживать простые шаблоны, например, такие как прямые линии, окружности или даже не имеющие никакого смысла для человеческого глаза шаблоны, которые тем не менее имеют огромное значение для этой модели. Такое "обнаружение" шаблонов называется обучением представления признаков. Теперь давайте рассмотрим 10-й сверточный слой VGG16, который использует ядро 3x3 с 512 картами признаков для обучения и в итоге генерирует вывод представления изображения размерности 28x28x512. Нейроны 10-го слоя уже могут обнаруживать более сложные шаблоны такие как, например, колесо автомобиля, окно или дерево и т.д.

Собственно вышеперечисленные свойства характерны для любой сверточной нейронной сети, работа которой обычно интерпретируется как переход от конкретных особенностей изображения к более абстрактным деталям, и далее к ещё более абстрактным деталям вплоть до выделения понятий высокого уровня. При этом сеть самонастраивается и вырабатывает необходимую иерархию абстрактных признаков (последовательности карт признаков), фильтруя маловажные детали и выделяя существенное.

Такая природа представления кодирования сама по себе является ключом к передаче стиля, который используется для вычисления функции потерь между сгенерированным изображением относительно изображения контента и изображения стиля. При обучении модели более десяти тысяч изображений на класс модель может генерировать аналогичное представление признаков для множества различных изображений, если они принадлежат к одному классу или имеют схожий контент или стиль.

Следовательно, имеет смысл использовать разницу в значении представления признаков сгенерированного изображения по содержанию и по стилю изображения, чтобы направлять итерации, через которые мы производим само сгенерированное изображение, но как убедиться, что изображение с содержанием C и сгенерированное изображение G похожи по своему содержанию, а не по стилю, в то время как сгенерированное изображение наследует только похожее представление стиля изображения стиля S, а не само изображение стиля в целом. Это решается разделением функции потерь на две части: одна - потеря контента, а другая - потеря стиля.

Loss function

Как вы можете видеть в приведенном выше уравнении, есть две вещи, которые нам нужно рассчитать, чтобы получить общую потерю: потеря содержимого и потеря стиля, альфа- и бета-гиперпараметры, которые используются для определения весов для каждого типа потерь, то есть эти параметры можно представить просто как ручки для управления тем, сколько контента / стиля мы хотим наследовать в сгенерированном изображении. Итак, давайте разберемся, что влечет за собой каждый из этих термов.

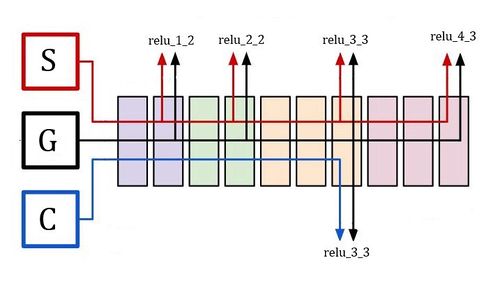

Какие входы для этой функции потерь отображаются выше? Мы понятия не имеем, как может выглядеть окончательный результат. Таким образом, наивный подход контролируемого обучения может не сработать. Ответ лежит на изображении ниже. (Рисунок 6)

Во время каждой итерации все три изображения, то есть изображение контента, изображение стиля и сгенерированное изображение, передаются через модель vgg16. Значение активации скрытого модуля, который кодирует представление объекта данного изображения на определенных слоях, принимается как входные данные для этих функций потерь, проще говоря, вы можете напрямую думать об этом как о получении выходных данных слоев в сети VGG16, и это не так. Никаких жестких и быстрых правил по подбору слоев. Еще одна вещь, которую нужно добавить здесь: изначально мы случайным образом инициализируем сгенерированное изображение, если вы посмотрите на него, то это не более чем матрица случайного шума формы, такая же, как изображение контента. С каждой итерацией мы изменяем сгенерированное изображение, чтобы минимизировать общую потерю L.

Примечание: Здесь после каждого слоя Convolution его выход передается через relu в качестве функции активации, вы также можете проверить на рисунке 2, где каждый блок Convolution представлен как [Convolution + Relu]

Content Loss

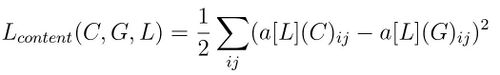

Потери контента легко рассчитать, давайте возьмем функциональное представление только одного из уровней, давайте рассмотрим 7-й слой свертки vgg16. Чтобы вычислить потерю контента, мы пропускаем и изображение контента, и сгенерированное изображение через vgg16 и получаем значения активации (то есть выходы) 7-го слоя конвоя для обоих этих изображений, для которых имеется Relu, поэтому мы будем обозначать выход этого слоя в целом как relu_3_3, поскольку это выход третьего сверточного слоя третьего набора / блока сверток (для справки см. рис. 2 и 6). Наконец, мы находим L2 Норму поэлементного вычитания между этими двумя матрицами активации следующим образом: Это поможет сохранить исходный контент в сгенерированном изображении, убедившись, что минимизируется разница в представлении объектов, которая логически фокусируется на разнице между содержимым обоих изображений.

Чтобы поместить эту потерю в математическую форму или уравнение, которое мы можем вычислить. Допустим, у нас есть функция Content loss, которая принимает в качестве входных данных три аргумента: изображение контента C, сгенерированное изображение G и слой L, активацию которого мы будем использовать для вычисления потерь. Теперь давайте обозначим каждый слой активации изображения контента как a[L](C), а слой активации сгенерированного изображения как a[L](G).

Style Loss

Теперь давайте посмотрим на потерю стиля, а при расчете потери стиля мы рассмотрим представление характеристик многих слоев свертки от мелких до более глубоких слоев модели. В отличие от потери контента, мы не можем просто найти разницу в единицах активации. Нам нужен способ найти корреляцию между этими активациями по разным каналам одного и того же слоя, и для этого нам нужно нечто, называемое матрицей Грама.

Gram Matrix

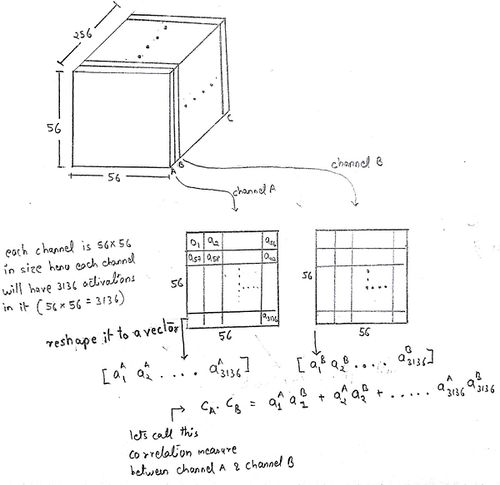

Я попытаюсь создать основу, необходимую для понимания матрицы грамм, на примере. Итак, давайте рассмотрим, как мы передаем наше изображение стиля через vgg16 и получаем значения активации из 7-го уровня, который генерирует матрицу представления объектов размером 56x56x256, которую вы можете использовать на рисунке 2, который описывает архитектуру vgg16. Теперь давайте подробнее рассмотрим этот вывод.

В этом 3-D массиве имеется 256 каналов размером 56x56 каждый. Теперь давайте предположим, что есть канал ‘A’, чьи блоки активации могут активироваться, когда они сталкиваются с разделом изображения, содержащим черные и коричневые полосы, а затем есть канал ‘B’, чьи блоки активации могут активироваться, когда они сталкиваются с чем-то похожим на глазное яблоко

Примечание: здесь активируемые юниты относятся к ним, имеющим значительно большую ценность по сравнению с нулем после прохождения через relu.

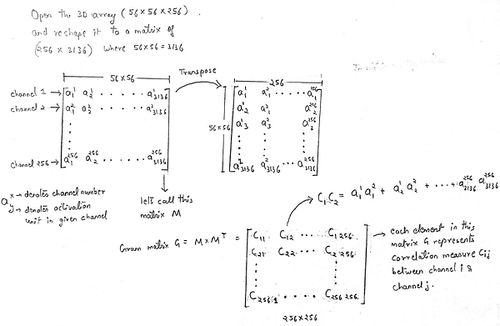

Если оба этих канала ‘A’ & ‘B’ активируются вместе для одного и того же входа, существует высокая вероятность того, что изображение может содержать лицо тигра (поскольку у него было два канала с высокими значениями, которые активируются для глазного яблока и коричневых черных полос) , Теперь, если оба эти канала будут запущены с высокими значениями активации, это означает, что они будут иметь высокую корреляцию по сравнению с корреляцией между каналом ‘A’ & ‘C’, где канал ‘C’ может активироваться, когда он видит ромбовидный шаблон. Таким образом, чтобы получить корреляцию всех этих каналов друг с другом, нам нужно вычислить что-то, называемое граммовой матрицей, мы будем использовать грамм-матрицу для измерения степени корреляции между каналами, которая позже будет служить мерой самого стиля. Теперь вы, возможно, поняли значение грамм-матрицы, но чтобы понять, как мы получаем грамм-матрицу из вышеупомянутого трехмерного массива, рассмотрим изображение, упомянутое ниже.

Теперь, как вы можете видеть, как каждый элемент этой граммовой матрицы содержит меру корреляции всех каналов относительно друг друга. Продвигаясь вперед, как мы используем эту вычисленную матрицу Грамма G для расчета потери стиля. Обозначим грамм-матрицу стилевого изображения слоя L как GM[L](S), а грамм-матрицу сгенерированного изображения того же слоя, что и GM[L](G). Обе матрицы грамм были вычислены из одного и того же слоя, следовательно, с использованием одного и того же числа каналов, что привело к тому, что он стал матрицей размера ch x ch. Теперь, если мы найдем сумму квадратичной разности или L2_norm вычитания элементов этих двух матриц и попытаемся минимизировать это, то это в конечном итоге приведет к минимизации разницы между стилем изображения изображения и сгенерированного изображения. Подумайте об этом, это может занять некоторое время, но когда это произойдет, вы будете загипнотизированы тем, насколько это просто, но эффективно.

В вышеприведенном уравнении N_l представляет номер канала в карте признаков / выходных данных уровня l, а M_l представляет высоту * ширину карты объектов / выходных данных слоя l.

В то время как при вычислении потери стиля мы используем несколько уровней активации, эти сценарии приводят нас к возможности назначать разные весовые коэффициенты для каждой подпотери, предоставляемой разными уровнями. ниже уравнения суммирует то, что я только что сказал, довольно элегантно, но в нашем случае или в большинстве случаев в целом люди дают одинаковый вес для всех слоев.

Пример кода на PyTorch

class ContentLoss(nn.Module):

def __init__(self, target,):

super(ContentLoss, self).__init__()

# we 'detach' the target content from the tree used

# to dynamically compute the gradient: this is a stated value,

# not a variable. Otherwise the forward method of the criterion

# will throw an error.

self.target = target.detach()

def forward(self, input):

self.loss = F.mse_loss(input, self.target)

return input