Автоматическое машинное обучение

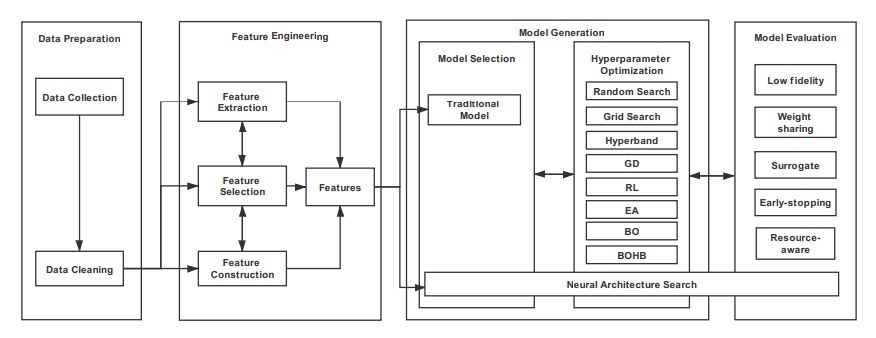

Автоматическое машинное обучение — процесс создания динамической комбинации различных методов для формирования простой в использовании сквозной конвейерной системы машинного обучения. AutoML использует хорошо зарекомендовавшие себя методы, которые мы классифицируем в следующие категории на основе пайплайна машинного обучения (показано на Рис.1): подготовка данных, конструирование признаков, генерация моделей и их оценка.

Подготовка данных состоит из двух этапов: сбор данных и их предварительная обработка.

Конструирование признаков состоит из 3 процессов: извлечение признаков, выбор признаков и построение признаков.

Этап генерации модели включает в себя выбор модели и оптимизацию гиперпараметров выбранной модели.

Градиентный спуск (gradient descent, GD), обучение с подкреплением (reinforcement learning, RL), волюционный алгоритм

(evolutionary algorithm, EA), байесовская оптимизация (Bayesian optimization, BO), байесовская оптимизация на основе гиперболы (Bayesian-optimization based hyperband, BOBH).

Подготовка данных

Первым шагом в пайплайне машинного обучения идет этап подготовки данных. Как правило, во многих задачах, например, распознавание изображений в медицине, бывает трудно получить достаточно данных, или качественно размеченных данных. Мощная система AutoML должна уметь справляться с этой проблемой. Для исследования этой задачи процесс подготовки данных разделяется на два подэтапа: сбор данных и их предобработка.

Сбор данных

Углубленное изучение ML привело к консенсусу, что качественные данные общедоступны. В результате появилось множество открытых наборов данных. Однако, как правило, очень трудно найти надлежащий набор данных с помощью вышеуказанных подходов для специализированных задач, таких как медицинская помощь или другие частные вопросы. Для решения этой задачи предлагается два типа методов: синтез данных и поиск данных.

Синтез данных

Одним из наиболее часто используемых методов является аугментация существующего набора данных. Для данных изображений существует множество операций аугментации, таких как обрезка, поворот, изменение размера и т.д.

Также, существуют два подхода к созданию дополнительных обучающих примеров: искажение данных и синтетическая избыточная выборка. Первый генерирует дополнительные семплы, применяя преобразования к пространству данных, а второй создает дополнительные семплы в пространстве признаков. Текстовые данные могут быть дополнены синонимами или сначала переводом текста на иностранный язык, а затем переводом его обратно на оригинальный.

Плюс ко всему, одним из распространенных методов является Генеративно-Состязательные Сети, которые, в основном, применяются для генерации картинок и текстов.

Поиск данных

Так как интернет является неисчерпаемым источником данных, поиск веб-данных - это интуитивно понятный способ сбора наборов данных. Тем не менее, есть некоторые проблемы с использованием данных, полученных таким образом.

Во-первых, результаты поиска могут не совсем совпадать с ключевыми словами. Чтобы решить эту проблему, несвязанные данные могут быть отфильтрованы.

Во-вторых, веб-данные могут быть неправильно размечены или не размечены вовсе. Для решения этой проблемы часто используется метод self_labeling. К примеру, метод активного обучения выбирает наиболее "неопределенные" неразмеченные отдельные примеры для разметки вручную, а затем итеративно размечаются оставшиеся данные. Чтобы полностью устранить потребность в разметке данных вручную и еще больше ускорить этот процесс, предлагается множество методов self-labeling с частичным привлечением учителя.

Однако, имеет также место быть проблема того, что наш набор данных не сбалансирован. Решением этой проблемы является, к примеру, алгоритм SMOTE, который помогает синтезировать новые данные, которые будут относиться к миноритарным классам, а также уменьшать количество данных, относящихся к мажоритарным классам.

Предварительная обработка данных

После того, как необработанные данные были собраны, они должны быть предварительно обработаны, чтобы удалить избыточные, неполные или неправильные данные. Например, распространенными типами ошибок в полученных набор данных являются пропущенные значения и неправильные типы данных. Типичными операциями, используемыми для обработки данных, являются стандартизация, масштабирование, бинаризация количественных характеристик и замена недостающих значений средними значениями.

При работе с картинками, может быть проблема, что картинка имеет неверную метку. В таких случаях применимы такие методы, как self-labeling. Тем не менее, процесс обработки данных обычно должен быть определен заранее вручную, потому что разные методы могут иметь различные требования, даже для одного и того же набора данных. Например, нейронная сеть может работать только с числовыми данными, в то время как методы, основанные на деревьях принятия решений, могут работать как с числовыми, так и с категориальными данными.

Конструирование признаков

Конструирование признаков состоит из трёх подэтапов: выбор признаков (feature selection), извлечение признаков (feature extraction) и построение признаков (feature construction). Извлечение и построение признаков - это варианты преобразования, с помощью которых создается новый набор признаков. Во многих случаях, целью feature extraction является уменьшение исходной размерности путём применения некоторых функций отображения, в то время как feature construction используется для расширения исходного пространства признаков. Цель feature selection состоит в том, чтобы уменьшить избыточность признаков путем выбора наиболее важных из них. В итоге, суть автоматического конструирования признаков в некоторой степени заключается в динамическом сочетание этих трех принципов.

Выбор признаков

Feature selection строит подмножество объектов на основе исходного набора объектов путем сокращения нерелевантных или избыточных признаков. Это, как правило, упрощает модель, таким образом, избегая переобучения и улучшая производительность модели. Выбранные объекты обычно расходятся и сильно коррелируют со значениями объектов.

Стратегия поиска для feature selection включает в себя три типа алгоритмов: полный поиск, эвристический поиск и случайный поиск.

Методы оценки получившихся подмножеств можно разделить на три основные категории.

Первая — это метод фильтрации, который оценивает каждый признак в соответствии с его дивергенцией или корреляцией, а затем выбирает признаки в соответствии с установленным порогом. Обычно для каждого признака используются такие методы оценки, как дисперсия, коэффициент корреляции и критерий хи-квадрат.

Вторая — метод обертки, который классифицирует выборку с выбранным подмножеством признаков, после чего точность классификации используется в качестве меры для измерения качества подмножества признаков.

Третий — это embedded-метод, в котором выбор осуществляется в процессе обучения. Пример embedded-методов - регуляризация и дерево принятия решений.

Построение признаков

Это процесс создания новых признаков из исходного пространства или необработанных данных с целью улучшения качества и обобщаемой способности модели. Этот процесс сильно зависит от человеческого опыта, и одним из наиболее часто используемых методов являются препроцессинговые преобразования, такие как стандартизация, нормализация или дискретизация признаков. Кроме того, операции преобразования для различных типов признаков могут отличаться. Например, такие операции, как конъюнкция, дизъюнкция и отрицание, обычно используются для булевых признаков; такие операции, как минимум, максимум, сложение, вычитание, среднее значение, обычно используются для числовых признаков.

Невозможно вручную исследовать все возможности. Таким образом, для дальнейшего повышения эффективности были предложены некоторые автоматические методы построения признаков, которые позволяют достичь результатов, которые не уступают или даже превосходят результаты, достигнутые человеческим опытом. Эти алгоритмы направлены на автоматизацию процесса поиска и оценки комбинации операций.

Извлечение признаков

Это процесс уменьшения размерности пространства признаков путем применения некоторых функций отображения.Он извлекает наиболее информативные признаки с учетом выбранных метрик. В отличие от feature selection, feature extraction изменяет исходные признаки. Главной частью feature extraction является функция отображения, которая может быть реализована многими способами. Наиболее распространенными подходами является Метод главных компонент (PCA), метод независимых компонент (ICA), isomap, нелинейное уменьшение размерности.

Генерация модели

После генерации признаков нам нужно сгенерировать модель и задать ее гиперпараметры. Как показано на Рис. 1, генерация модели состоит из двух этапов: выбора модели и оптимизации гиперпараметров.

Существует множество способов выбора модели. Ниже приведены некоторые из них:

TPOT (Tree-base Pipeline Optimization Tool)

В основе TPOT лежит эволюционный алгоритм поиска для нахождения параметров и лучших модельных ансамблей. TPOT пытается создать конвеер, оценивает его производительность и случайным образом изменяет части конвеера в поиске наибольшей эффективности. У TPOT займет некоторое время, чтобы работать на достаточно больших наборах данных, и очень важно понять, почему. С настройками TPOT по умолчанию (100 поколений с размером популяции 100) TPOT оценит 10000 конфигураций конвеера до завершения. Чтобы понять, насколько это много, подумайте о grid search из 10000 комбинаций гиперпараметров для алгоритма машинного обучения и о том, сколько времени займет этот поиск. Это 10000 конфигураций модели для оценки с 10-fold кросс-валидацией, что означает, что примерно 100000 моделей подходят и оцениваются на обучающих данных в одном grid search. Поэтому, для некоторых наборов данных требуется всего несколько минут, чтобы найти высокопроизводительную модель для работы, а некоторым может потребоваться несколько дней.

Auto-WEKA

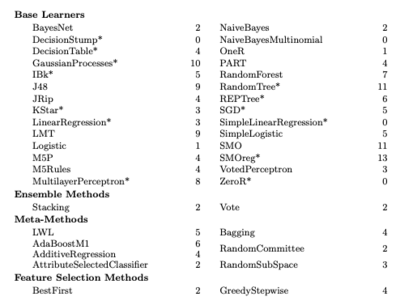

Данный способ позволяет нам одновременно выбирать лучшую модель и настраивать ее гиперпараметры. На рис.3 показаны 28 базовых алгоритмов, 7 мета-алгоритмов и 2 ансамблевых алгоритма. При автоматическом выборе модели, они пробуются все, и выбирается один лучший с уже настроенными гиперпараметрами. Время работы алгоритма достаточно долгое, потому что нам нужно перебрать все возможные алгоритмы и для каждого из них настроить его гиперпараметры.

Auto-sklearn

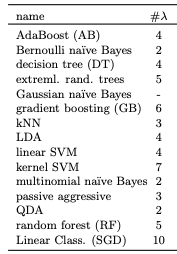

Так же, как и в Auto-WEKA, в Auto-sklearn мы можем автоматически выбрать лучшую модель из тех, что поддерживаются, и сразу настроить ее гиперпараметры.

На рис.4 показано, что Auto-sklearn поддерживает 15 алгоритмов и у каждого из них свое количество гиперпараметров.

Сначала используется мета-обучение на основе различных признаков и мета-признаков набора данных, чтобы найти наилучшие модели. После этого используется подход байесовской оптимизации, чтобы найти лучшие гиперпараметры для выбранных моделей.

Оценка модели

После того, как новая нейронная сеть была сгенерирована, ее производительность должна быть оценена. Интуитивный метод состоит в том, чтобы обучить сеть сходиться, а затем оценить ее производительность. Однако этот метод требует значительных временных и вычислительных ресурсов. Для ускорения процесса оценки модели было предложено несколько алгоритмов, которые приведены ниже.

Низкая точность (Low fidelity)

Поскольку время обучения модели тесно связано с набором данных и размером модели, оценка модели может быть ускорена различными способами.

Во-первых, может быть уменьшено количество изображений, или их разрешение (в терминах задач классификации изображений).

Во-вторых, оценка модели может быть реализована путем уменьшения размера модели, например, путем обучения с меньшим количеством фильтров на слой.

Суррогатный метод (Surrogate method)

Суррогатный метод - это еще один мощный инструмент, который аппроксимирует black-box функцию. В общем случае, как только получено хорошее приближение, задача найти конфигурации, которые непосредственно оптимизируют исходную дорогостоящую цель, становится тривиальной. К примеру, прогрессивный поиск оптимизации нейронной сети (PNAS) вводит суррогатную модель для управления методом поиска. Хотя было доказано, что эффективный поиск нейронной сети (ENAS) очень эффективен, PNAS еще более эффективен, поскольку число моделей, оцениваемых PNAS, более чем в пять раз превышает число моделей, оцениваемых ENAS, и PNAS в восемь раз быстрее с точки зрения общей вычислительной скорости. Однако, когда пространство оптимизации слишком велико и трудно поддается количественной оценке, а оценка каждой конфигурации чрезвычайно дорогостоящая, суррогатный метод неприменим.

Ранняя остановка (Early stopping)

Метод ранней остановки впервые был применен для избежания переобучения в классических задачах машинного обучения. Он используется для ускорения оценки модели путем остановки оценивания, которое, как предполагается, плохо работает на валидационном наборе.

Оптимизация ресурсов (Resource-aware)

В большинстве исследований в прошлом больше внимания уделялось поиску нейронных архитектур, достигающих более высокой производительности (например, точности классификации), независимо от связанного с этим потребления ресурсов (т.е. количества графических процессоров и требуемого времени). Поэтому во многих последующих исследованиях исследуются алгоритмы, учитывающие ресурсы (resource-aware), чтобы найти компромисс между эффективностью и количеством вычислительных ресурсов. Для этого эти алгоритмы добавляют вычислительную стоимость к функции потерь в качестве ограничения ресурсов.

Эти алгоритмы отличаются друг от друга типом вычислительной стоимости, которым могут являться:

- число параметров

- число операций умножения-накопления (MAC)

- число операций с плавающей точкой (FLOP)

- действительная задержка