Вариации регрессии — различия между версиями

Penguinni (обсуждение | вклад) м (→Байесовская регрессия) |

Penguinni (обсуждение | вклад) м (→Описание) |

||

| Строка 90: | Строка 90: | ||

<center><tex>Q_{\lambda}(\beta) = ||F \beta - y||^2 + \lambda ||\beta||</tex>,</center> | <center><tex>Q_{\lambda}(\beta) = ||F \beta - y||^2 + \lambda ||\beta||</tex>,</center> | ||

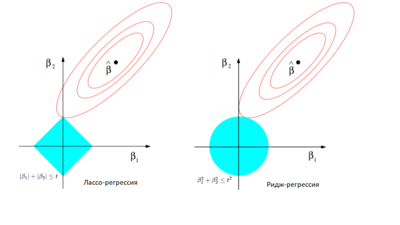

| − | Основное различие лассо- и ридж-регрессии заключается в том, что первая может приводить к обращению некоторых независимых переменных в ноль, тогда как вторая уменьшает их до значений, близких к нулю. Рассмотрим для простоты двумерное пространство независимых переменных. В случае | + | Основное различие лассо- и ридж-регрессии заключается в том, что первая может приводить к обращению некоторых независимых переменных в ноль, тогда как вторая уменьшает их до значений, близких к нулю. Рассмотрим для простоты двумерное пространство независимых переменных. В случае лассо-регрессии органичение на коэффициенты представляет собой ромб (<tex>|\beta_1| + |\beta_2| \leq t</tex>), в случае ридж-регрессии {{---}} круг (<tex>\beta_1^2 + \beta_2^2 \leq t^2</tex>). Необходимо минимизировать функцию ошибки, но при этом соблюсти ограничения на коэффициенты. С геометрической точки зрения задача состоит в том, чтобы найти точку касания линии, отражающей функцию ошибки с фигурой, отражающей ограничения на <tex>\beta</tex>. Из рисунка 1 интуитивно понятно, что в случае лассо-регрессии эта точка с большой вероятностью будет находиться на углах ромба, то есть лежать на оси, тогда как в случае ридж-регрессии такое происходит очень редко. Если точка пересечения лежит на оси, один из коэффициентов будет равен нулю, а значит, значение соответствующей независимой переменной не будет учитываться. |

===Пример кода для Scikit-learn=== | ===Пример кода для Scikit-learn=== | ||

Версия 14:27, 24 февраля 2019

Регрессия (англ. Regression) — метод моделирования зависимости между зависимой переменной и одной или несколькими независимыми переменными . В случае нескольких независимых переменных регрессия называется множественной (англ. multivariate regression). Цель регрессионного анализа состоит в том, чтобы оценить значение непрерывной выходной переменной по значениям входных переменных.

Содержание

Линейная регрессия

Линейная регрессия (англ. linear regression) — разновидность регрессии для моделирования линейной зависимости между зависимой и независимой переменными.

Логистическая регрессия

Логистическая регрессия (англ. logistic regression) — разновидность регрессии для прогнозирования вероятности некоторого события по значениям независимых переменных. Зависимая переменная в этом случае принимает значения или (рассматриваемое событие не произошло или произошло соответственно).

Гребневая регрессия (ридж-регрессия)

Гребневая регрессия или ридж-регрессия (англ. ridge regression) — один из методов понижения размерности. Применяется для борьбы с избыточностью данных, когда независимые переменные коррелируют друг с другом, вследствие чего проявляется неустойчивость оценок коэффициентов многомерной линейной регрессии.

Мотивация

| Определение: |

| Мультиколлинеарность (англ. multicollinearity) — наличие линейной зависимости между независимыми переменными регрессионной модели. Различают полную коллинеарность и частичную или просто мультиколлинеарность — наличие сильной корреляции между независимыми переменными. |

Рассмотрим пример линейной модели: . Пусть имеет место зависимость . Добавим к первому коэффициенту произвольное число , а из двух других коэффициентов это же число вычтем. Получаем (без случайной ошибки):

Несмотря на относительно произвольное изменение коэффициентов модели мы получили исходную модель, то есть такая модель неидентифицируема.

На практике чаще встречается проблема сильной корреляции между независимыми переменными. В этом случае оценки параметров модели получить можно, но они будут неустойчивыми.

Описание

Напомним задачу многомерной линейной регрессии:

Рассматривается линейная зависимость .

Находим вектор , при котором достигается минимум среднего квадрата ошибки:

Методом наименьших квадратов находим решение:

В условиях мультиколлинеарности матрица становится плохо обусловленной.

Для решения этой проблемы наложим ограничение на величину коэффициентов : .

Функционал с учетом ограничения принимает вид:

- ,

где — неотрицательный параметр.

Решением в этом случае будет

Это изменение увеличивает собственные значения матрицы , но не изменяет ее собственные вектора. В результате имеем хорошо обусловленную матрицу.

Диагональная матрица называется гребнем.

Пример кода для Scikit-learn

# импорт библиотек from sklearn.datasets import make_regression from sklearn.linear_model import Ridge from sklearn.model_selection import train_test_split # генерируем данные для X и y X, y = make_regression(n_samples=10000, noise=100, random_state=0) # разделение данных на train и test train_X, test_X, train_y, test_y = train_test_split(X, y, test_size=0.3, random_state=3) ridge_regression = Ridge(alpha=0.1) # alpha — величина регуляризации # обучение ridge_regression.fit(train_X, train_y) # предсказание результата print(ridge_regression.predict(test_X)) # вывод точности предсказания print(ridge_regression.score(test_X, test_y))

Точность предсказания для данного датасета и параметров:

>>> 0.8171822749108134

Лассо-регрессия

Описание

Метод регрессии лассо (англ. LASSO, Least Absolute Shrinkage and Selection Operator) похож на гребневую регрессию, но он использует другое ограничение на коэффициенты :

Функционал принимает следующий вид:

Основное различие лассо- и ридж-регрессии заключается в том, что первая может приводить к обращению некоторых независимых переменных в ноль, тогда как вторая уменьшает их до значений, близких к нулю. Рассмотрим для простоты двумерное пространство независимых переменных. В случае лассо-регрессии органичение на коэффициенты представляет собой ромб (), в случае ридж-регрессии — круг (). Необходимо минимизировать функцию ошибки, но при этом соблюсти ограничения на коэффициенты. С геометрической точки зрения задача состоит в том, чтобы найти точку касания линии, отражающей функцию ошибки с фигурой, отражающей ограничения на . Из рисунка 1 интуитивно понятно, что в случае лассо-регрессии эта точка с большой вероятностью будет находиться на углах ромба, то есть лежать на оси, тогда как в случае ридж-регрессии такое происходит очень редко. Если точка пересечения лежит на оси, один из коэффициентов будет равен нулю, а значит, значение соответствующей независимой переменной не будет учитываться.

Пример кода для Scikit-learn

# импорт библиотек from sklearn.datasets import make_regression from sklearn.linear_model import Lasso from sklearn.model_selection import train_test_split # генерируем данные для X и y X, y = make_regression(n_samples=10000, noise=100, random_state=0) # разделение данных на train и test train_X, test_X, train_y, test_y = train_test_split(X, y, test_size=0.3, random_state=3) lasso_regression = Lasso(alpha=0.1) # alpha — величина регуляризации # обучение lasso_regression.fit(train_X, train_y) # предсказание результата print(lasso_regression.predict(test_X)) # вывод точности предсказания print(lasso_regression.score(test_X, test_y))

Точность предсказания для данного датасета и параметров:

>>> 0.8173906804156383

Байесовская регрессия

Описанные выше методы никак не учитывали наличие в данных шума, тогда как в реальных данных он скорее всего будет присутствовать. Предположим, что в данных все же есть некоторый шум, и что он распределен нормально. Тогда задачу линейной регрессии можно записать в следующем виде:

- , где .

Решением этой задачи мы и будем заниматься в этом разделе.

Байесовская линейная регрессия (англ. Bayesian linear regression) — подход в линейной регрессии, в котором предполагается что шум распределен нормально.

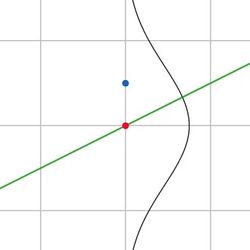

На рисунке 2 синяя точка показывает значения из датасета, красная — значение, предсказанное регрессией. Поскольку центр гауссианы находится в красной точке, маленькие отклонения синей точки от красной более вероятны, а большие менее вероятны.

Для решения поставленной задачи регрессии воспользуемся методом максимального правдоподобия.

Запишем правдоподобие:

Будем предполагать, что данные независимы:

Прологарифмируем это выражение:

Из оценки максимального правдоподобия мы получили оценку по методу наименьших квадратов.

Пример кода для Scikit-learn

# импорт библиотек from sklearn.datasets import make_regression from sklearn.linear_model import BayesianRidge from sklearn.model_selection import train_test_split # генерируем данные для X и y X, y = make_regression(n_samples=10000, noise=100, random_state=0) # разделение данных на train и test train_X, test_X, train_y, test_y = train_test_split(X, y, test_size=0.3, random_state=3) bayesian_regression = BayesianRidge() # обучение bayesian_regression.fit(train_X, train_y) # предсказание результата print(bayesian_regression.predict(test_X)) # вывод точности предсказания print(bayesian_regression.score(test_X, test_y))

Точность предсказания для данного датасета и параметров:

>>> 0.8170548749907206

Логическая регрессия

Логическая регрессия (англ. logic regression) — обобщенный метод регрессии, применяемый в основном в случае, когда независимые переменные имеют двоичную природу (при этом зависимая переменная не обязательно двоичная). Задачей логической регрессии является определение независимых переменных, которые могут быть выражены как результат вычисления булевой функции от других независимых переменных.

Пусть — двоичные независимые переменные, и пусть — зависимая переменная. Будем пытаться натренировать модели регрессии вида , где — булева функция от переменных (например ).

Для каждого типа модели необходимо определить функцию, которая отражает качество рассматриваемой модели. Например, для линейной регрессии такой функцией может быть остаточная сумма квадратов. Целью метода логической регрессии является минимизация выбранной функции качества посредством настройки параметров одновременно с булевыми выражениями .

См. также

- Общие понятия

- Линейная регрессия

- Логистическая регрессия

- Обзор библиотек для машинного обучения на Python

- Байесовская классификация

- Уменьшение размерности

Источники информации

- 10 типов регрессии — какой выбрать?

- machinelearning.ru — Линейная регрессия (пример)

- machinelearning.ru — Ридж-регрессия

- Wikipedia — Мультиколлинеарность

- Лекции по алгоритмам восстановления регрессии К. В. Воронцов

- Ridge and Lasso Regression: A Complete Guide with Python Scikit-Learn

- Habr — Базовые принципы машинного обучения на примере линейной регрессии

- Documents on Logic Regression