Выброс

Выброс (англ. outlier) — небольшая доля объектов во входных данных, которая сильно выделяется из общей выборки. Многие алгоритмы машинного обучения чувствительны к разбросу и распределению значений атрибутов во входных данных. Соответственно выбросы во входных данных могут исказить и ввести в заблуждение процесс обучения алгоритмов машинного обучения, что приводит к увеличению времени обучения, снижению точности моделей и, в конечном итоге, к снижению результатов. Даже до подготовки предсказательных моделей на основе обучающих данных выбросы могут приводить к ошибочным представлениям и в дальнейшем к ошибочной интерпретации собранных данных.

Виды выбросов

Выбросы могут быть двух видов: одномерные и многомерные. Одномерные выбросы можно найти при рассмотрении распределения значений объектов в одном пространстве. Многомерные выбросы можно найти в n-мерном пространстве (из n-объектов). Рассмотрение распределений в n-мерных пространствах может быть очень сложным для человеческого мозга, поэтому необходимо обучить модель, чтобы сделать это.

Выбросы также могут отличаться в зависимости от окружающей среды: точечные выбросы, контекстуальные выбросы или коллективные выбросы. Точечные выбросы — это единичные точки данных, расположенные далеко от остальной части распределения. Контекстные выбросы могут представлять собой шум в данных, например, знаки препинания при выполнении анализа текста или сигнал фонового шума при распознавании речи. Коллективные выбросы могут быть подмножествами новшеств в данных, таких как сигнал, который может указывать на открытие новых явлений.

Причины возникновения выбросов

- Сбой работы оборудования

- Человеческий фактор

- Случайность

- Уникальные явления

- и др.

Примеры

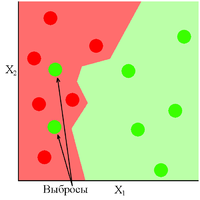

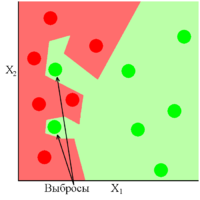

Рис 2 показывает хорошо обученную модель, в которой присутствуют два выброса. Как видно из рисунка данная модель показала себя устойчивой к выбросам, либо же вовремя прекратила своё обучение. Обратная ситуация обстоит с Рис 3, где модель сильно переобучилась из-за присутствующих в ней выбросов.

Методы обнаружения и борьбы с выбросами

Методы обнаружения выбросов

- Экстремальный анализ данных(англ. extreme value analysis). При таком анализе не применяются какие-либо специальные статистические методы. Обычно этот метод применим для одномерного случая. Алгоритм использования таков:

- Визуализировать данные, используя диаграммы и гистограммы для нахождения экстремальных значений.

- Задействовать распределение, например Гауссовское, и найти значения, чье стандартное отклонение отличается в 2-3 раза от математического ожидания или в полтора раза от первой либо третьей квартилей.

- Отфильтровать предполагаемые выбросы из обучающей выборки и оценить работу модели.

- Апроксимирующий метод (англ. proximity method). Чуть более сложный метод, заключающийся в применении кластеризующих методов.

- Использовать метод кластеризации для определения кластеров для данных.

- Идентифицировать и отметить центроиды каждого кластера.

- Соотнести кластеры с экземплярами данных, находящимися на фиксированном расстоянии или на процентном удалении от центроиды соответствующего кластера.

- Отфильтровать предполагаемые выбросы из обучающей выборки и оценить работу модели.

- Проецирующие методы (англ. projections methods). Эти методы довольно быстро и просто определяют выбросы в выборке.

- Использовать один из проецирующих методов, например метод главных компонент (англ. principal component analysis, PCA[1]) или самоорганизующиеся карты Кохонена(англ. self-organizing map, SOM[2]) или проекцию Саммона(англ. Sammon mapping, Sammon projection[3]), для суммирования обучающих данных в двух измерениях.

- Визуализировать отображение

- Использовать критерий близости от проецируемых значений или от вектора таблицы кодирования (англ. codebook vector) для идентифицирования выбросов.

- Отфильтровать предполагаемые выбросы из обучающей выборки и оценить работу модели.

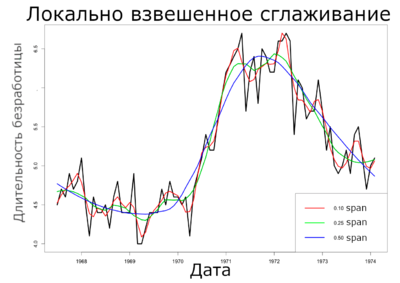

Локально взвешенное сглаживание

Локально взвешенное сглаживание(англ. LOcally WEighted Scatter plot Smoothing, LOWESS)[4]. Данная методика была предложена Кливлендом(Cleveland) в 1979 году для моделирования и сглаживания двумерных данных . Эта техника предоставляет общий и гибкий подход для приближения двумерных данных. Локально-линейная модель может быть записана в виде: . Эта модель может быть расширена на случай локально-квадратичной зависимости и на модель с бо‘льшим числом независимых переменных. Параметры и локально линейной модели оцениваются с помощью локально взвешенной регрессии, которая присваивает объекту тем больший вес, чем более близок он к объекту t. Степень сглаживания определяется параметром сглаживания , который выбирает пользователь. Параметр указывает, какая доля (fraction) данных используется в процедуре. Если , то только половина данных используется для оценки и влияет на результат, и тогда мы получим умеренное сглаживание. С другой стороны, если , то используются восемьдесят процентов данных, и сглаживание намного сильнее. Во всех случаях веса данных тем больше, чем они ближе к объекту .

Постановка задачи

Пусть задано пространство объектов $X$ и множество возможных ответов . Существует неизвестная зависимость , значения которой известны только на объектах обучающией выборки . Требуется построить алгоритм , аппроксимирующий неизвестную зависимость . Предполагается, что на множестве $X$ задана метрика .

Также стоит определить следующее. Для вычисления при , воспользуемся методом наименьших квадратов:

, где - это вес $i$-ого объекта. Веса разумно задать так, чтобы они убывали по мере увеличения расстояния . Для этого можно ввести невозрастающую, гладкую, ограниченную функцию , называемую ядром, и представить в следующем виде :

, где $h$ — ширина окна.

Приравняв нулю производную , и, выразив ,получаем формулу Надарая-Ватсона[5] :

Проблема выбросов в этой задаче

Большие случайные ошибки в значениях сильно искажают оценку Надарая-Ватсона

Идея

Чем больше величина невязки , тем меньше должен быть вес i-го объекта

Эвристика

Домножить веса на коэффиценты , где — ещё одно ядро, вообще говоря, отличное от

Псевдокод

INPUT: - training sample; OUTPUT: coefficents ; ________________________________________________________ 1: initialization: ; //инициализация коэффициентов 2: do 3: for each object ; 4: calculate cross-validation estimates: { \color{green}//вычислить оценки скользящего контроля} 5: for each object ; 6: 7: while coefficents not stabilized; { \color{green} //пока коэффициенты не стабилизируются}

Пример на языке R

В этом примере мы попытаемся локально регрессировать и сгладить среднюю продолжительность безработицы на основе набора экономических данных из пакета $ggplot2$ языка $R$. Мы рассматриваем только первые 80 строк для этого анализа, поэтому легче наблюдать степень сглаживания на приведенных ниже графиках.

# data(economics, package="ggplot2") # загрузка данных economics$index <- 1:nrow(economics) # создание индексной переменной economics <- economics[1:80, ] # усечение до 80 строк для более наглядного демонстрирования loessMod10 <- loess(uempmed ~ index, data=economics, span=0.10) # 10% параметр сглаживания span loessMod25 <- loess(uempmed ~ index, data=economics, span=0.25) # 25% параметр сглаживания span loessMod50 <- loess(uempmed ~ index, data=economics, span=0.50) # 50% параметр сглаживания span

# получить сглаженный результат smoothed10 <- predict(loessMod10) smoothed25 <- predict(loessMod25) smoothed50 <- predict(loessMod50)

# Нарисовать plot(economics$uempmed, x=economics$date, type="l", main="Локально взвешенное сглаживание", xlab="Дата", ylab="Длительность безработицы") lines(smoothed10, x=economics$date, col="red") lines(smoothed25, x=economics$date, col="green") lines(smoothed50, x=economics$date, col="blue")

Другие алгоритмы борьбы с выбросами

В статистике методы, устойчивые к нарушениям модельных предположений о данных, называются робастными. Метод локально взвешенного сглаживания относится к робастным методам, так как он устойчив к наличию небольшого количества выбросов.

- Дерево принятия решения (англ. decision tree[6]). Это дерево, как и уже описанный алгоритм локально взвешенного сглаживания, относится к робастным методам.

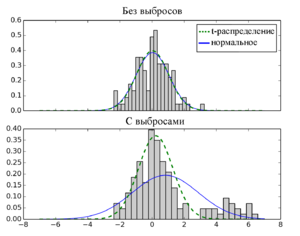

- Робастная регрессия (англ. robust regression[7]). В отличии от регрессии, использующей, например, метод наименьших квадратов, в этом алгоритме не строится идеализированное предположение, что вектор ошибок распределен согласно нормальному закону. Однако на практике зачастую имеют место отклонения от этого предположения. Тогда можно применить метод наименьших модулей (англ. Least Absolute Deviation, LAD [8]) в случае, если распределение ошибок измерений подчиняется распределению Лапласа (англ. Laplace distribution [9]).