Механизм внимания — различия между версиями

м (→Модули внимания: изменен приоритет заголовков) |

м (→Модули внимания: еще ссылки) |

||

| Строка 98: | Строка 98: | ||

=== Spatial Attention Module === | === Spatial Attention Module === | ||

| − | Пространственный механизм внимания реализуется за счет исследования пространственных взяимосвязей, и в отличие от канального фокусируется на том, "где" находится информация во входных данных. В данном случае для сжатия размерности используются те же пулинги, но относительно измерения <math>C</math>. Таким образом на выходе мы получаем две матрицы <math>F^s_{max}</math> и <math>F^s_{avg}</math> из <math>\mathbb{R}^{H \times W}</math>. После чего они конкатенируются и к полученному тензору размерности <math>\mathbb{R}^{2 \times H \times W}</math> применяется [[:Сверточные_нейронные_сети#Свертка|свертка]], уменьшающая число каналов до одного и не меняющая остальные размерности, а к результату поэлементно применяется сигмоидная функция активации. Полученный тензор из <math>\mathbb{R}^{1 \times H \times W}</math> как раз является результатом применения <math>A_2(F_1)</math>, поэлементное произведение которого с <math>F_1</math> дает выходной тензор <math>F_2</math>, который называется выходным множеством признаков c размерностью <math>\mathbb{R}^{C \times H \times W}</math>. | + | Пространственный механизм внимания реализуется за счет исследования пространственных взяимосвязей, и в отличие от канального фокусируется на том, "где" находится информация во входных данных. В данном случае для сжатия размерности используются те же [[:Сверточные_нейронные_сети#Пулинговый слой|пулинги]], но относительно измерения <math>C</math>. Таким образом на выходе мы получаем две матрицы <math>F^s_{max}</math> и <math>F^s_{avg}</math> из <math>\mathbb{R}^{H \times W}</math>. После чего они конкатенируются и к полученному тензору размерности <math>\mathbb{R}^{2 \times H \times W}</math> применяется [[:Сверточные_нейронные_сети#Свертка|свертка]], уменьшающая число каналов до одного и не меняющая остальные размерности, а к результату поэлементно применяется сигмоидная функция активации. Полученный тензор из <math>\mathbb{R}^{1 \times H \times W}</math> как раз является результатом применения <math>A_2(F_1)</math>, поэлементное произведение которого с <math>F_1</math> дает выходной тензор <math>F_2</math>, который называется выходным множеством признаков c размерностью <math>\mathbb{R}^{C \times H \times W}</math>. |

==Self-Attention== | ==Self-Attention== | ||

Версия 19:28, 2 декабря 2020

Механизм внимания (англ. attention mechanism, attention model) — техника используемая в рекуррентных нейронных сетях (сокр. RNN) и сверточных нейронных сетях (сокр. CNN) для поиска взаимосвязей между различными частями входных и выходных данных.

Изначально механизм внимания был представлен в контексте рекуррентных Seq2seq[1] сетей [2] для "обращения внимания" блоков декодеров на скрытые состояния RNN для любой итерации энкодера, а не только последней.

После успеха этой методики в машинном переводе последовали ее внедрения в других задачах обработки естественного языка и применения к CNN для генерации описания изображения[3] и порождающих состязательных сетях[4] (сокр. GAN).

Содержание

Обобщенный механизм внимания

Обобщенный механизм внимания (англ. general attention) — разновидность механизма внимания, задачей которой является выявление закономерности между входными и выходными данными. Изначально механизм внимания представленный в оригинальной статье[5] подразумевал именно этот тип внимания.

Пример использования обобщенного механизма внимания для задачи машинного перевода

Для лучшего понимания работы обобщенного механизма внимания будет рассмотрен пример его применения в задаче машинного перевода при помощи Seq2seq сетей для решения которой он изначально был представлен.

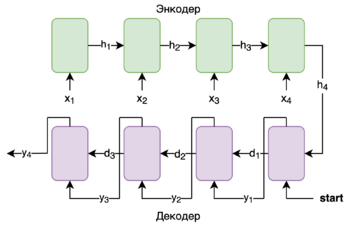

Базовая архитектура Seq2seq

Для понимания механизма внимания в Seq2seq сетях необходимо базовое понимание Seq2seq архитектуры до введения механизма внимания.

Seq2seq состоит из двух RNN — Энкодера и Декодера.

Энкодер — принимает предложение на языке A и сжимает его в вектор скрытого состояния.

Декодер — выдает слово на языке B, принимает последнее скрытое состояние энкодера и предыдущее предыдущее предсказанное слово.

Рассмотрим пример работы Seq2seq сети:

— слова в предложении на языке A.

— скрытое состояние энкодера.

Блоки энкодера (зеленый) — блоки энкодера получающие на вход и передающие скрытое состояние на следующую итерацию.

— скрытое состояние декодера.

— слова в предложении на языке B.

Блоки декодера (фиолетовый) — блоки декодера получающие на вход или специальный токен start в случае первой итерации и возвращаюшие — слова в предложении на языке B. Передают — скрытое состояние декодера на следующую итерацию. Перевод считается завершенным при , равном специальному токену end.

Применение механизма внимания для Seq2seq

Несмотря на то, что нейронные сети рассматриваются как "черный ящик" и интерпретировать их внутренности в понятных человеку терминах часто невозможно, все же механизм внимания интуитивно понятный людям смог улучшить качество машинного перевода базового Seq2seq алгоритма.

Успех использования этого подхода в задаче машинного перевода обусловлен лучшим выводом закономерностей между словами находящимися на большом расстоянии друг от друга. Несмотря на то, что LSTM и GRU блоки используются именно для улучшения передачи информации с предыдущих итераций RNN их основная проблема заключается в том, что влияние предыдущих состояний на текущее уменьшается экспоненциально от расстояния между словами, в то же время механизм внимания улучшает этот показатель до линейного[6].

RNN используются при обработке данных, для которых важна их последовательность. В классическом случае применения RNN результатом является только последнее скрытое состояние , где — длина последовательности входных данных. Использование механизма внимания позволяет использовать информацию полученную не только из последнего скрытого состояния, но и любого скрытого состояния для любого .

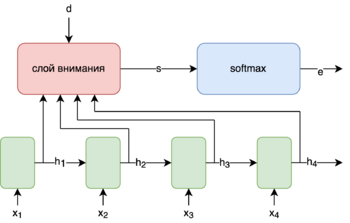

Устройство слоя механизма внимания

Слой механизма внимания представляет собой обычную, чаще всего однослойную, нейронную сеть на вход которой подаются , а также вектор в котором содержится некий контекст зависящий от конкретной задачи.

В случае Seq2seq сетей вектором будет являться скрытое состояние предыдущей итерации декодера.

Выходом данного слоя будет является вектор (англ. score) — оценки на основании которых на скрытое состояние будет "обращено внимание".

Далее для нормализации значений используется [7]. Тогда

здесь используется благодаря своим свойствам:

Далее считается (англ. context vector)

Результатом работы слоя внимания является который, содержит в себе информацию обо всех скрытых состояниях пропорционально оценке .

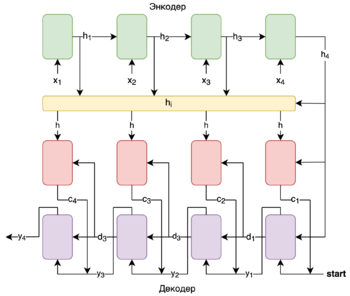

Применение механизма внимания к базовой Seq2seq архитектуре

При добавлении механизма в данную архитектуру между RNN Энкодером и Декодером слоя механизма внимания получится следующая схема:

Здесь имеют те же назначения, что и в варианте без механизма внимания.

Агрегатор скрытых состояний энкодера (желтый) — агрегирует в себе все вектора и возвращает всю последовательность векторов .

— вектор контекста на итерации .

Блоки механизма внимания (красный) — принимает и , возвращает .

Блоки декодера (фиолетовый) — по сравнению с обычной Seq2seq сетью меняются входные данные. Теперь на итерации на вход подается не , а конкатенация и .

Таким образом при помощи механизма внимания достигается "фокусирование" декодера на определенных скрытых состояниях. В случаях машинного перевода эта возможность помогает декодеру предсказывать на какие скрытые состояния при исходных определенных словах на языке A необходимо обратить больше внимания при переводе данного слова на язык B. То есть на какие слова из исходного текста обратить внимание при переводе конкретного слова на язык назначения.

Модули внимания

Convolutional Block Attention Module

Convolutional Block Attention Module — простой, но эффективный модуль внимания для сверточных нейросетей. Данный модуль внимания состоит из двух последовательно применяемых подмодулей - канального (Channel Attention Module, применяется ко всем каналам одного пикселя с изображения) и пространственного (Spatial Attention Module, применяется ко всему изображению с фиксированным каналом).

Устройство

Более формально говоря: на вход подается множество признаков , где - число каналов, - высота, а - длина изображения. Канальный подмодуль принадлежит множеству , а пространственный принадлежит множеству . Таким образом применение модуля можно описать так:

Здесь за обозначено поэлементное произведение, а тензоры и копируются вдоль недостающих измерений. является выходным множеством признаков.

Channel Attention Module

Канальный механизм внимания реализуется за счет исследования внутриканальных взяивосвязей во входных данных, фокусируясь на том "какая" информация находится в данных. Для более эффективной реализации используется сжатие входных данных по измерениям и с помощью пулингов и , в результате которого получаются два вектора и из . После чего к этим двум векторам независимо применяется одна и та же полносвязная нейронная сеть с одним скрытым слоем малой размерности (при этом ее входные и выходные вектора принадлежат ). После этого полученные из нейросети вектора поэлементно складываются, к результату поэлементно применяется сигмоидная функция активации и добавляются недостающие единичные размерности. Полученный тензор из как раз и является результатом применения , поэлементное произведение которого со входом дает тензор

Spatial Attention Module

Пространственный механизм внимания реализуется за счет исследования пространственных взяимосвязей, и в отличие от канального фокусируется на том, "где" находится информация во входных данных. В данном случае для сжатия размерности используются те же пулинги, но относительно измерения . Таким образом на выходе мы получаем две матрицы и из . После чего они конкатенируются и к полученному тензору размерности применяется свертка, уменьшающая число каналов до одного и не меняющая остальные размерности, а к результату поэлементно применяется сигмоидная функция активации. Полученный тензор из как раз является результатом применения , поэлементное произведение которого с дает выходной тензор , который называется выходным множеством признаков c размерностью .

Self-Attention

Self-Attention — разновидность механизма внимания, задачей которой является выявление закономерности только между входными данными.

Данная методика показала себя настолько эффективной в задаче машинного перевода, что позволила отказаться от использования RNN и заменить их на обычные нейронные сети в комбинации с механизмом Self-attention в архитектуре трансформер[8].

Это позволило ускорить работу алгоритма, поскольку ранее предложение обрабатывалось последовательно при помощи RNN. При использовании трансформера каждое слово в предложении обрабатывается может обрабатываться параллельно.

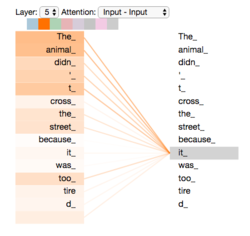

Основным отличием Self-Attention от обобщенного механизма внимания является, что он делает заключения о зависимостях исключительно между входными данными.

Рассмотрим предложение The animal didn't cross the street because it was too tired и результат работы алгоритма Self-attention для слова it. Полученный вектор соответствует взаимосвязи слова it со всеми остальными словам в предложении.

Из визуализации вектора можно заметить, что механизм Self-attention обнаружил взаимосвязь между словами it и animal. Этот результат можно интуитивно объяснить с человеческой точки зрения, что позволяет алгоритмам машинного обучения, использующим данный подход, лучше решать задачу принимая во внимание контекстные взаимосвязи.

Также Self-Attention успешно применяется применяется в GAN сетях, в частности в алгоритме SAGAN[9].

См. также

Источники информации

- Статья о механизме внимания, его типах и разновидностях

- Лекция Andrew Ng о механизме внимания в NLP

- Статья с подробно разборанными примерами и кодом на Python и TensorFlow

- Статья c примерами работы Self-attention

Примечания

- ↑ Wiki -- Seq2seq

- ↑ https://arxiv.org/abs/1409.0473

- ↑ https://arxiv.org/abs/1502.03044

- ↑ https://arxiv.org/abs/1805.08318

- ↑ https://arxiv.org/abs/1409.0473

- ↑ https://towardsdatascience.com/transformers-141e32e69591

- ↑ Wiki -- Функция softmax

- ↑ https://papers.nips.cc/paper/7181-attention-is-all-you-need.pdf

- ↑ https://arxiv.org/abs/1805.08318