Глубокое обучение — различия между версиями

(→ПО для глубокого обучения) |

(→История) |

||

| Строка 4: | Строка 4: | ||

== История == | == История == | ||

| − | + | * 1943 - Искусственный нейрон Маккаллока — Питтса<ref>[https://en.wikipedia.org/wiki/Artificial_neuron Artificial neuron, Wikipedia]</ref> | |

| − | + | * 1949 - Принчип обучения нейронов Хебба<ref>[https://en.wikipedia.org/wiki/Hebbian_theory Hebbian theory, Wikipedia]</ref> | |

| − | + | * 1957 - Модель перцептрона предложена Фрэнком Розенблаттом<ref>[https://en.wikipedia.org/wiki/Perceptron Perceptron, Wikipedia]</ref> | |

| − | + | * 1960 - Дельта-правило обучения перцептрона<ref>[https://en.wikipedia.org/wiki/Delta_rule Delta rule, Wikipedia]</ref> | |

| − | + | * 1969 - Выход книги Марвина Минска и Сеймура Паперта "Перцептроны"<ref>[https://en.wikipedia.org/wiki/Perceptrons_(book) Perceptrons book, WIkipedia]<ref> | |

| − | * | + | * 1974 - Метод обратного распространения ошибки впервые предложен А. И. Галушкиным и Дж. Вербосом<ref>[https://en.wikipedia.org/wiki/Backpropagation Backpropagation, Wikipedia]</ref> |

| − | * | + | * 1980 - Первая свёрточная нейронная сеть предложена Кунихико Фукусимой<ref>[https://en.wikipedia.org/wiki/Convolutional_neural_network Convolutional_neural_network, Wikipedia]</ref> |

| − | * | + | * 1982 - Рекуррентные нейронные сети предложены Д. Хопфилдом |

| − | * | + | * 1991 - "Проблема исчезающего градиента" была сформулирована С. Хочрейтом |

| + | * 1997 - Долгая краткосрочная память предложена С. Хочрейтом и Ю. Шмидхубером<ref>[https://en.wikipedia.org/wiki/Long_short-term_memory Long short-term memory, Wikipedia]</ref> | ||

| + | * 1998 - Градиентный спуск для сверточных нейронных сетей предложена Я. Лекуном | ||

| + | * 2006 - Глубокая модель предложена Г. Хинтоном, С. Осиндером и Я. Техом | ||

| + | * 2012 - Предложение исключений(дропаута) Г. Хинтоном, А. Крижевски и И. Шутковичем<ref>[https://en.wikipedia.org/wiki/Dropout_(neural_networks) Dropout, Wikipedia]</ref> | ||

| + | * 2012 - Нейронные сети побеждают ImageNet<ref>[https://ru.wikipedia.org/wiki/ImageNet ImageNet, Wikipedia]</ref>. Начало эры нейронных сетей и глубокого обучения. | ||

== Определение == | == Определение == | ||

Версия 19:22, 7 декабря 2018

Глубокое обучение (англ. deep learning) — совокупность широкого семейства методов машинного обучения, основанных на обучении представлениям, а не специализированным алгоритмам под конкретные задачи. Глубокое обучение может быть с учителем, с частичным привлечением учителя, без учителя и с подкреплением. Несмотря на то, что данный раздел машинного обучения появился еще в 1980-х, до недавнего времени его применение было сильно ограничено из-за недостака вычислительных мощностей существовавших компьютеров. Ситуация изменилась только в середине 2000-х.

На создание моделей глубокого обучения оказали влияние некоторые процессы и паттерны, происходящие в биологических нейронных системах. Несмотря на это, данные модели имеют множество различий с биологическим мозгом (и в структуре и в функциях), что делает невозможным использование теорем и доказательств, применяющихся нейробиологии.

Содержание

История

- 1943 - Искусственный нейрон Маккаллока — Питтса[1]

- 1949 - Принчип обучения нейронов Хебба[2]

- 1957 - Модель перцептрона предложена Фрэнком Розенблаттом[3]

- 1960 - Дельта-правило обучения перцептрона[4]

- 1969 - Выход книги Марвина Минска и Сеймура Паперта "Перцептроны"Ошибка цитирования Отсутствует закрывающий тег

</ref> - 1980 - Первая свёрточная нейронная сеть предложена Кунихико Фукусимой[5]

- 1982 - Рекуррентные нейронные сети предложены Д. Хопфилдом

- 1991 - "Проблема исчезающего градиента" была сформулирована С. Хочрейтом

- 1997 - Долгая краткосрочная память предложена С. Хочрейтом и Ю. Шмидхубером[6]

- 1998 - Градиентный спуск для сверточных нейронных сетей предложена Я. Лекуном

- 2006 - Глубокая модель предложена Г. Хинтоном, С. Осиндером и Я. Техом

- 2012 - Предложение исключений(дропаута) Г. Хинтоном, А. Крижевски и И. Шутковичем[7]

- 2012 - Нейронные сети побеждают ImageNet[8]. Начало эры нейронных сетей и глубокого обучения.

Определение

Глубокое обучение — это класс алгоритмов машинного обучения, который:

- использует многослойную систему нелинейных фильтров для извлечения признаков с преобразованиями. Каждый последующий слой получает на входе выходные данные предыдущего слоя.

- может сочетать алгоритмы обучения с учителем (пример — классификация) и без учителя (пример — анализ образца).

- формирует в процессе обучения слои выявления признаков на нескольких уровнях представлений, которые соответствуют различным уровням абстракции; при этом признаки организованы иерархически - признаки более высокого уровня являются производными от признаков более низкого уровня.

Нейронные сети

- Искусственные нейронные сети (англ. artificial neural networks (ANN))[9]

- Глубокие нейронные сети (англ. deep neural network (DNN))[10]

Применения

- Распознавание речи[11]

- Компьютерное зрение[12]

- Обработка визуальных изображений[13]

- Обработка естественного языка[14]

- Обнаружение новых лекарственных препаратов

- Рекомендательные системы[15]

- Предсказание генномных онтологий в биоинформатике[16]

Полный список возможных применений глубокого обучения[17].

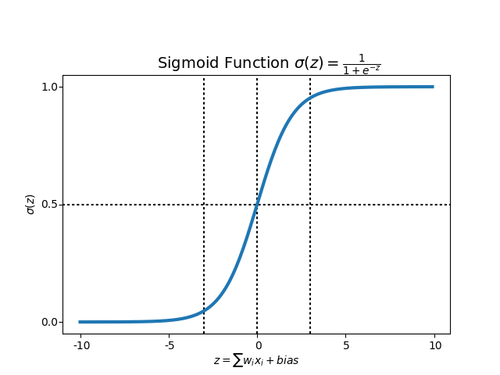

Sigmoid function

У ступенчатых функций есть определенное количество ограничений, связанных с ее линейностью. Если функция активации является линейной, то независимо от количества складываемых скрытых слоев в нейронной сети, конечный результат по-прежнему будет являеться линейной комбинацией исходных входных данных. Эта линейность означает, что она не может реально охватить сложность нелинейных задач, таких как оператор XOR или различные паттерны, разделенные кривыми или кругами. Другой проблемой является то, что перцептрон с ступенчатой функцией не очень «стабилен», то есть может перейти из состояния 0 в 1 и из 0 в 1 при небольших изменениях в любом из весов входного слоя.

Для того, чтобы избежать данных проблем, в нейронных сетях используется sigmoid функция в качестве активационной.

Функция sigmoid, в отличие от ступенчатой функции, вводит нелинейность в выбранную модель нейронной сети. Нелинейность означает, что выход, получаемых из нейрона, который является произведением некоторых входов и весов плюс смещение, а затем помещаемый в sigmoid функцию, не может быть представлен линейной комбинацией входов .

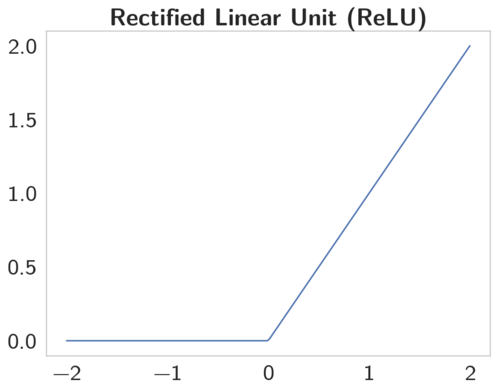

Rectified Linear Units (ReLU)

Несмотря на множество сильных сторон sigmoid функции, у нее есть значительные недостатки. Производная такой функции крайне мала во всех точках, кроме сравнительно небольшого промежутка. Это сильно усложняет процесс улучшения весов с помощью градиентного спуска. Эта проблема усугубляется в случае, если модель содержит больше слоев. Данная проблема называется проблемой исчезающего градиента.[18]

Функция ReLU имеет производную равную 0 для всех отрицательных значениях и 1 для положительных. Таким образом, когда обучение происходит на датасетах разумного размера, обычно находятся точки данных, дающие положительные значения для любого выбранного узла. Таким образом, средняя производная редко бывает близка к 0, что позволяет продолжать градиентный спуск.

Rectified Linear Unit — это наиболее часто используемая активационная функция при глубоком обучении. Данная функция возвращает 0, если принимает отрицательный вход, в случае же положительного входа, функция возвращает само число. Таким образом функция может быть записана как .

Функция ReLU отлично работает в большинстве приложений, в результате чего она получила широкое распространение. Данная функция позволяет правильно учитывать нелинейности и взаимодействия.

Фреймворки для глубокого обучения

- TensorFlow[19]

- Microsoft Cognitive Toolkit[20]

- Wolfram Mathematica[21]

- Keras[22]

- Deeplearning4j[23]

- Caffe[24]

- Torch/PyTorch[25]

- MXNet[26]

- Chainer[27]

Сопоставление фреймворков, библиотек и отдельных программ для глубокого обучения[28].

См. также

- Нейронные сети, перцептрон[на 06.12.18 не создан]

- Сверточные нейронные сети[на 06.12.18 не создан]

- Рекуррентные нейронные сети [на 06.12.18 не создан]

- Обучение с подкреплением [на 06.12.18 не создан]

Примечания

- ↑ Artificial neuron, Wikipedia

- ↑ Hebbian theory, Wikipedia

- ↑ Perceptron, Wikipedia

- ↑ Delta rule, Wikipedia

- ↑ Convolutional_neural_network, Wikipedia

- ↑ Long short-term memory, Wikipedia

- ↑ Dropout, Wikipedia

- ↑ ImageNet, Wikipedia

- ↑ Artificial neural network, Wikipedia

- ↑ Deep neural networks , Wikipedia

- ↑ Speech recognition, Wikipedia

- ↑ Задача нахождения объектов на изображении[на 06.12.18 не создан]

- ↑ Visual art processing , Wikipedia

- ↑ Natural language processing, Wikipedia

- ↑ Recommender system, Wikipedia

- ↑ Deep learning in bioinformatics, Wikipedia

- ↑ Applications of deep learning, Wikipedia

- ↑ Vanishing gradient problem, Wikipedia

- ↑ TensorFlow, Wikipedia

- ↑ Microsoft Cognitive Toolkit, Wikipedia

- ↑ Wolfram Mathematica, Wikipedia

- ↑ Keras, Wikipedia

- ↑ Deeplearning4j, Wikipedia

- ↑ Caffe, Wikipedia

- ↑ PyTorch — ваш новый фреймворк глубокого обучения, habr

- ↑ MXNet, official site

- ↑ Chainer, official site

- ↑ Comparison of deep learning software, Wikipedia