|

|

| Строка 37: |

Строка 37: |

| | Корреляция лежит на отрезке <tex>[-1, 1]</tex>. | | Корреляция лежит на отрезке <tex>[-1, 1]</tex>. |

| | | | |

| − | |proof=

| |

| − | Для доказательства будем использовать [[Ковариация случайных величин#Неравенство Коши — Буняковского | неравенство Коши-Буняковского]]:

| |

| | | | |

| − | <tex>\mathrm{Cov}^2(\eta, \xi) \leqslant \sigma_\eta ^2\sigma_\xi ^2</tex>

| |

| − |

| |

| − | Если правая часть не равна <tex>0</tex>, то приходим к следующему неравенству:

| |

| − |

| |

| − | <tex> \dfrac{\mathrm{Cov}^2(\eta,\xi)}{(\sigma_\eta ^2\sigma_\xi ^2)} \leqslant 1</tex>

| |

| − |

| |

| − | <tex>\mathrm{Corr}^2(\eta,\xi) \leqslant 1</tex>

| |

| − |

| |

| − | <tex>-1 \leqslant \mathrm{Corr}(\eta,\xi) \leqslant 1</tex>.

| |

| | | | |

| | }} | | }} |

| Строка 56: |

Строка 45: |

| | Если <tex> \mathrm{Corr}(\eta, \xi) = \pm 1 </tex>, то <tex>\eta</tex> и <tex>\xi</tex> линейно зависимы. | | Если <tex> \mathrm{Corr}(\eta, \xi) = \pm 1 </tex>, то <tex>\eta</tex> и <tex>\xi</tex> линейно зависимы. |

| | | | |

| − | |proof=

| |

| − | В доказательстве будем использовать [[Ковариация случайных величин#Неравенство Коши — Буняковского | неравенство Коши-Буняковского]]. <br>

| |

| − | Так как <tex> \mathrm{Corr}(\eta, \xi) = \pm 1 </tex>, тo <tex>\mathrm{Cov}^2(\eta,\xi) = \sigma_\eta ^2\sigma_\xi ^2</tex>

| |

| | | | |

| − | Из этого следует, что дискриминант этого уравнения <tex>\sigma_\xi ^2t^2+2\mathrm{Cov}(\eta,\xi)t+\sigma_\eta ^2 = 0</tex> равен <tex>0</tex> .

| |

| − |

| |

| − | То есть уравнение имеет единственный корень <tex> t_0 </tex>.

| |

| − |

| |

| − | Получаем, что <tex>\sigma_\xi ^2t_0 ^2+2\mathrm{Cov}(\eta,\xi) t_0+\sigma_\eta ^2 = 0</tex>.

| |

| − |

| |

| − | Из этого следует, что <tex> E\big((\xi-E(\xi) +t_0 \eta - t_0 E(\eta))^2\big) = 0 </tex>

| |

| − |

| |

| − | Это возможно только тогда, когда <tex> \xi-E(\xi) +t_0 \eta - t_0 E(\eta) = 0</tex>;

| |

| − |

| |

| − | Видим, что <tex>\eta</tex> и <tex>\xi</tex> линейно зависимы.

| |

| | }} | | }} |

| | | | |

| Строка 77: |

Строка 52: |

| | Если <tex>\eta</tex> и <tex>\xi</tex> линейно зависимы, то <tex>\mathrm{Corr}(\eta, \xi)= \pm 1 </tex>. | | Если <tex>\eta</tex> и <tex>\xi</tex> линейно зависимы, то <tex>\mathrm{Corr}(\eta, \xi)= \pm 1 </tex>. |

| | | | |

| − | |proof=

| |

| − | Предположим, что существует линейная зависимость: <tex>\xi = k \times \eta + b</tex>.

| |

| − | Тогда мы имеем <tex>E(\xi)=k E(\eta) + b</tex>

| |

| − |

| |

| − | <tex> \mathrm{Cov}(\eta, \xi) = E((\eta - E(\eta))(\xi - E\xi))=k E\big((\eta-E(\eta))^2\big)=k \sigma_\eta ^2 </tex>.

| |

| − |

| |

| − | По свойству дисперсии <tex> \sigma_\xi ^2 = D(\xi) = E\big((\xi-E(\xi))^2\big)= k^2 E\big((\eta-E(\eta))^2\big)= k^2 \sigma_\eta ^2 </tex>

| |

| | | | |

| − | Получаем, что

| |

| − | <tex>\mathrm{Corr}(\eta, \xi)= \dfrac{\mathrm{Cov}(\eta, \xi)}{\sigma_\eta \sigma_\xi}=\dfrac{k}{|k|}</tex>.

| |

| | }} | | }} |

| | | | |

| Определение: |

Среднеквадратичным отклонением (англ. standart deviation) [math]\sigma_{\eta}[/math] называется величина, равная квадратному корню из дисперсии случайной величины [math]\eta[/math]

- [math]\sigma_{\eta}=\sqrt{D(\eta)}[/math]

|

| Определение: |

Пусть [math]\eta,\xi[/math] — две случайные величины, определённые на одном и том же вероятностном пространстве. Тогда корреляцией случайных величин (англ. correlation) [math]\eta[/math] и [math]\xi[/math] называется выражение следующего вида:

- [math]\mathrm{Corr}(\eta,\xi)=\dfrac{\mathrm{Cov}(\eta,\xi)}{\sigma_{\eta}\sigma_{\xi}}[/math], где [math]\mathrm{Cov}(\eta,\xi)[/math] — ковариация случайных величин.

|

Вычисление

Заметим, что [math]\sigma_{\xi} = \sqrt{D(\xi)} = E\big((\xi-E(\xi))^2\big)[/math] — среднеквадратичное отклонение.

- [math]\mathrm{Corr}(\eta,\xi)=\dfrac{\mathrm{Cov}(\eta,\xi)}{\sigma_{\eta} \sigma_{\xi}} = \dfrac{E\big((\eta-E\eta)(\xi-E\xi)\big)}{{\sqrt{D(\eta)} \sqrt{D(\xi)}}} =\dfrac{E(\xi \eta) - E(\xi) E(\eta)}{{\sigma_{\eta} \sigma_{\xi}}}[/math]

Корреляция и взаимосвязь величин

Значительная корреляция между случайными величинами всегда означает, что присутствует некая взаимосвязь между значениями конкретной выборки, но при другой выборке связь вполне может отсутствовать. Поэтому при нахождении взаимосвязи не нужно делать поспешных выводов о причинно-следственном характере величин, а следует рассмотреть наиболее полную выборку, чтобы делать какие-либо выводы. Коэффициенты корреляции устанавливают лишь статистические взаимосвязи, но не более того.

Свойства корреляции

| Утверждение: |

Корреляция симметрична:

- [math]\mathrm{Corr}(\eta,\xi) = \mathrm{Corr}(\xi,\eta)[/math].

|

| [math]\triangleright[/math] |

- [math]\mathrm{Corr}(\eta,\xi) = \dfrac{ E(\eta \xi) - E(\eta) E(\xi)}{\sqrt{D(\eta)} \sqrt{D(\xi)} } = \dfrac{ E(\xi \eta) - E(\xi) E(\eta)}{\sqrt{D(\xi)} \sqrt{D(\eta)} } = \mathrm{Corr}(\xi,\eta)[/math].

|

| [math]\triangleleft[/math] |

| Утверждение: |

Корреляция случайной величины с собой равна [math]1[/math]. |

| [math]\triangleright[/math] |

- [math]\mathrm{Corr}(\eta,\eta) = \dfrac{ E(\eta \eta) - E(\eta) E(\eta)}{\sqrt{D(\eta)} \sqrt{D(\eta)} } = \dfrac{D(\eta)}{D(\eta)} = 1[/math]

|

| [math]\triangleleft[/math] |

| Утверждение: |

Корреляция лежит на отрезке [math][-1, 1][/math]. |

| Утверждение: |

Если [math] \mathrm{Corr}(\eta, \xi) = \pm 1 [/math], то [math]\eta[/math] и [math]\xi[/math] линейно зависимы. |

| Утверждение: |

Если [math]\eta[/math] и [math]\xi[/math] линейно зависимы, то [math]\mathrm{Corr}(\eta, \xi)= \pm 1 [/math]. |

| Утверждение: |

Если [math]\eta,\xi[/math] независимые случайные величины, то [math]\mathrm{Corr}(\eta,\xi) = 0[/math]. |

| [math]\triangleright[/math] |

|

Пусть [math]\eta[/math] и [math]\xi[/math] — независимые величины. Тогда [math]E(\eta \xi)=E(\eta) E(\xi)[/math], где [math]E[/math] — их математическое ожидание. Получаем:

- [math]\mathrm{Corr}(\eta, \xi) = \dfrac{E(\xi) E(\eta) - E(\xi) E(\eta)}{{E\big((\eta-E(\eta))^2\big) E\big((\xi-E(\xi))^2\big)}} = 0[/math]

Но обратное неверно:

Пусть [math]\eta[/math] — случайная величина, распределенная симметрично около [math]0[/math], а [math]\xi=\eta^2[/math]. [math]\mathrm{Corr}(\eta,\xi)=0[/math], но [math]\eta[/math] и [math]\xi[/math] — зависимые величины. |

| [math]\triangleleft[/math] |

Примеры

В общем смысле корреляция — это зависимость между случайными величинами, когда изменение одной влечет изменение распределения другой.

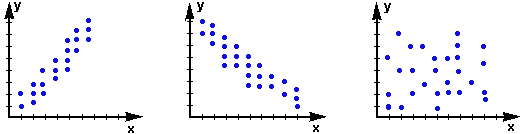

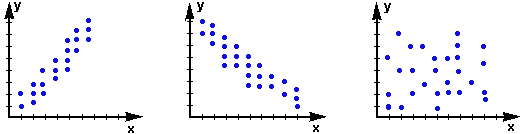

Определение корреляции по диаграмме

3 диаграммы рассеивания двух случайных величин

[math]X[/math] и

[math]Y[/math]- Соответственно, на первом графике изображена положительная корреляция, когда увеличение [math]Y[/math] ведет к постепенному увеличению [math]X[/math].

- Второй график отображает отрицательную корреляцию, когда увеличение [math]X[/math] воздействует на постепенное уменьшение [math]Y[/math].

- Третий график показывает, что [math]X[/math] и [math]Y[/math] связаны слабо, их распределение не зависит от изменения друг друга, поэтому корреляция между ними будет равна 0.

Определение корреляции по таблице

Рассмотрим 2 случайные величины: курс акций нефтедобывающей компании ([math]X[/math]) и цены на нефть ([math]Y[/math]).

| X

|

2003,6 |

2013,2 |

2007,6 |

2007,4 |

2039,9 |

2025 |

2007 |

2017 |

2015,6 |

2011

|

| Y

|

108,4 |

107,96 |

108,88 |

110,44 |

110,2 |

108,97 |

109,15 |

108,8 |

111,2 |

110,23

|

Для упрощения вычислений определим [math]X[/math] и [math]Y[/math] как равновероятные случайные величины. Тогда их математическое ожидание и дисперсию легко посчитать:

[math]E(X) = 2014,73[/math]

[math]E(Y) = 109,42[/math]

[math]D(X) = 104,9361[/math]

[math]D(Y) = 0,959661[/math]

Используя формулу, [math]\mathrm{Corr}(\eta,\xi)=\dfrac{E(\xi \eta) - E(\xi)E(\eta)}{{\sigma_{\eta} \sigma_{\xi}}}[/math] определяем, что корреляция между величинами [math]X[/math] и [math]Y[/math] составляет [math]0,240935496[/math], т.е. [math]24\%[/math].

См. также

Источники информации