Механизм внимания — различия между версиями

Gpevnev (обсуждение | вклад) |

Gpevnev (обсуждение | вклад) |

||

| Строка 5: | Строка 5: | ||

После успеха этой методики в машинном переводе последовали ее внедрения в других задачах [[:Обработка_естественного_языка|обработки естественного языка]] и применения к [[:Сверточные_нейронные_сети|CNN]] для генерации описания изображения<ref>https://arxiv.org/abs/1502.03044</ref> и GAN <ref>SAGAN</ref>. | После успеха этой методики в машинном переводе последовали ее внедрения в других задачах [[:Обработка_естественного_языка|обработки естественного языка]] и применения к [[:Сверточные_нейронные_сети|CNN]] для генерации описания изображения<ref>https://arxiv.org/abs/1502.03044</ref> и GAN <ref>SAGAN</ref>. | ||

| − | == | + | ==Обобщенный механизм внимания== |

[[File:AttentionGeneral.png|350px|thumb|Обобщенное описание механизма внимания]] | [[File:AttentionGeneral.png|350px|thumb|Обобщенное описание механизма внимания]] | ||

[[:Рекуррентные_нейронные_сети|RNN]] используются при обработке данных, для которых важна их последовательность. В классическом случае применения [[:Рекуррентные_нейронные_сети|RNN]] результатом является только последнее скрытое состояние <math>h_m</math>, где <math>m</math> {{---}} длина последовательности входных данных. Использование механизма внимания позволяет использовать информацию полученную не только из последнего скрытого состояниния, но и любого скрытого состояния <math>h_t</math> для любого <math>t</math>. | [[:Рекуррентные_нейронные_сети|RNN]] используются при обработке данных, для которых важна их последовательность. В классическом случае применения [[:Рекуррентные_нейронные_сети|RNN]] результатом является только последнее скрытое состояние <math>h_m</math>, где <math>m</math> {{---}} длина последовательности входных данных. Использование механизма внимания позволяет использовать информацию полученную не только из последнего скрытого состояниния, но и любого скрытого состояния <math>h_t</math> для любого <math>t</math>. | ||

| Строка 26: | Строка 26: | ||

Результатом работы слоя внимания является <math>c</math> который, содержит в себе информацию обо всех скрытых состоянях <math>h_i</math> пропорционально оценке <math>e_i</math>. | Результатом работы слоя внимания является <math>c</math> который, содержит в себе информацию обо всех скрытых состоянях <math>h_i</math> пропорционально оценке <math>e_i</math>. | ||

| − | ==Пример использования для задачи машинного перевода в ''Seq2seq'' сетях== | + | ===Пример использования для задачи машинного перевода в ''Seq2seq'' сетях=== |

Пример добавления механизма внимания в ''Seq2seq'' сеть поможет лучше понять его предназначение. | Пример добавления механизма внимания в ''Seq2seq'' сеть поможет лучше понять его предназначение. | ||

Изначально в оригинальной статье<ref>[https://arxiv.org/abs/1409.0473 Neural Machine Translation by Jointly Learning to Align and Translate]</ref>, представляющей механизм внимания, он применяется в контексте именно Seq2seq сети в задаче машинного перевода. | Изначально в оригинальной статье<ref>[https://arxiv.org/abs/1409.0473 Neural Machine Translation by Jointly Learning to Align and Translate]</ref>, представляющей механизм внимания, он применяется в контексте именно Seq2seq сети в задаче машинного перевода. | ||

| Строка 34: | Строка 34: | ||

Успех этого использования этого подхода в задаче машинного перевода обусловлен лучшим выводом закономерностей между словами находящимися на большом расстоянии друг от друга. Несмотря на то, что ''LSTM'' и ''GRU'' блоки используются именно для улучшения передачи информации с предыдущих итераций ''RNN'' их основная проблема заключается в том, что влияние предыдущих состояний на текущее уменьшается экспоненциально от расстояния между словами, в то же время механизм внимания улучшает этот показатель до линейного. | Успех этого использования этого подхода в задаче машинного перевода обусловлен лучшим выводом закономерностей между словами находящимися на большом расстоянии друг от друга. Несмотря на то, что ''LSTM'' и ''GRU'' блоки используются именно для улучшения передачи информации с предыдущих итераций ''RNN'' их основная проблема заключается в том, что влияние предыдущих состояний на текущее уменьшается экспоненциально от расстояния между словами, в то же время механизм внимания улучшает этот показатель до линейного. | ||

| − | === Базовая архитектура ''Seq2seq'' === | + | ====Базовая архитектура ''Seq2seq''==== |

[[File:Seq2SeqBasic.png|450px|thumb|Пример работы базовой ''Seq2seq'' сети]] | [[File:Seq2SeqBasic.png|450px|thumb|Пример работы базовой ''Seq2seq'' сети]] | ||

Данный пример рассматривает применение механизма внимания в задаче машинного перевода в применении к архитектуре ''Seq2seq''. | Данный пример рассматривает применение механизма внимания в задаче машинного перевода в применении к архитектуре ''Seq2seq''. | ||

| Строка 61: | Строка 61: | ||

Перевод считается завершенным при <math>y_i</math>, равном специальному токену '''end'''. | Перевод считается завершенным при <math>y_i</math>, равном специальному токену '''end'''. | ||

| − | === Применение механизма внимания для ''Seq2seq'' === | + | ====Применение механизма внимания для ''Seq2seq''==== |

| + | [[File:Seq2SeqAttention.png|450px|thumb|Пример работы ''Seq2seq'' сети с механизмом внимания]] | ||

При добавлении механизма в данную архитектуру между [[:Рекуррентные_нейронные_сети|RNN]] ''Энкодер'' и ''Декодер'' слоя механизма внимания получится следуюшая схема: | При добавлении механизма в данную архитектуру между [[:Рекуррентные_нейронные_сети|RNN]] ''Энкодер'' и ''Декодер'' слоя механизма внимания получится следуюшая схема: | ||

| − | |||

| − | |||

Здесь <math>x_i, h_i, d_i, y_i</math> имееют те же назначения, что и в варианте без механизма внимания. | Здесь <math>x_i, h_i, d_i, y_i</math> имееют те же назначения, что и в варианте без механизма внимания. | ||

| Строка 77: | Строка 76: | ||

Таким образом при помощи механизма внимания достигается "фокусирование" декодера на определенных скрытых состояниях. В случаях машинного перевода эта возможность помогает декодеру предсказывать на какие скрытые сосояния при исходных определенных словах на языке ''A'' необходимо обратить больше внимания при переводе данного слова на язык ''B''. | Таким образом при помощи механизма внимания достигается "фокусирование" декодера на определенных скрытых состояниях. В случаях машинного перевода эта возможность помогает декодеру предсказывать на какие скрытые сосояния при исходных определенных словах на языке ''A'' необходимо обратить больше внимания при переводе данного слова на язык ''B''. | ||

| + | |||

| + | ==Self-Attention== | ||

| + | |||

| + | TODO | ||

==См. также== | ==См. также== | ||

Версия 12:57, 22 марта 2020

Механизм внимания (англ. attention mechanism, attention model) — техника используемая в рекуррентных нейронных сетях (сокр. RNN) и сверточных нейронных сетях (сокр. CNN) для "обращения внимания" на определенные части входных данных в зависимости от текущего контекста.

Изначально механизм внимания был представлен в контексте рекуррентных Seq2seq сетей [1] для "обращения внимания" блоков декодеров на скрытые состояния RNN энкодера для любой итерации, а не только последней.

После успеха этой методики в машинном переводе последовали ее внедрения в других задачах обработки естественного языка и применения к CNN для генерации описания изображения[2] и GAN [3].

Содержание

Обобщенный механизм внимания

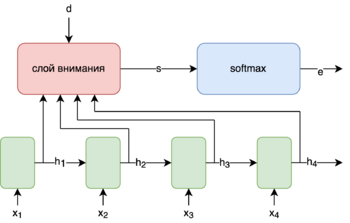

RNN используются при обработке данных, для которых важна их последовательность. В классическом случае применения RNN результатом является только последнее скрытое состояние , где — длина последовательности входных данных. Использование механизма внимания позволяет использовать информацию полученную не только из последнего скрытого состояниния, но и любого скрытого состояния для любого .

Обычно слой использующийся для механизма внимания представляет собой обычную, чаще всего однослойную, нейронную сеть на вход которой подаются , а также вектор в котором содержится некий контекст зависящий от конкретно задачи.

Выходом данного слоя будет являтся вектор (англ. score) — оценки на основании которых на скрытое состояние будет "обращено внимание".

Далее для нормализации значений используется [4]. Тогда

здесь используется благодоря своим свойствам:

Далее считается (англ. context vector)

Результатом работы слоя внимания является который, содержит в себе информацию обо всех скрытых состоянях пропорционально оценке .

Пример использования для задачи машинного перевода в Seq2seq сетях

Пример добавления механизма внимания в Seq2seq сеть поможет лучше понять его предназначение. Изначально в оригинальной статье[5], представляющей механизм внимания, он применяется в контексте именно Seq2seq сети в задаче машинного перевода.

Несмотря на то, что нейронные сети рассматриваются как "черный ящик" и интерпретировать их внутренности в понятных человеку терминах часто невозможно, все же механизм внимания интуитивно понятный людям смог улучшить результаты машинного перевода для алгоритма используемого в статье.

Успех этого использования этого подхода в задаче машинного перевода обусловлен лучшим выводом закономерностей между словами находящимися на большом расстоянии друг от друга. Несмотря на то, что LSTM и GRU блоки используются именно для улучшения передачи информации с предыдущих итераций RNN их основная проблема заключается в том, что влияние предыдущих состояний на текущее уменьшается экспоненциально от расстояния между словами, в то же время механизм внимания улучшает этот показатель до линейного.

Базовая архитектура Seq2seq

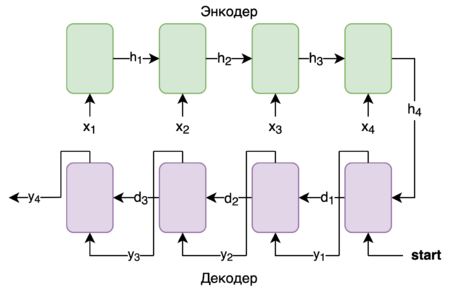

Данный пример рассматривает применение механизма внимания в задаче машинного перевода в применении к архитектуре Seq2seq.

Seq2seq состоит из двух RNN — Энкодера и Декодера.

Энкодер — принимает предложение на языке A и сжимает его в вектор скрытого состояния.

Декодер — выдает слово на языке B, принимает последнее скрытое состояние энкодера и предыдущее предыдущее предсказаное слово.

Рассмотрим пример работы Seq2seq сети:

— слова в предложении на языке A.

— скрытое состояние энкодера.

Блоки энкодера (зеленый) — блоки энкодера получающие на вход и передающие скрытое состояние на следующую итерацию.

— скрытое состояние декодера.

— слова в предложении на языке B.

Блоки декодера (фиолетовый) — блоки декодера получающие на вход или специальный токен start в случае первой итерации и возвращаюшие — слова в предложении на языке B. Передают — скрытое состояние декодера на следующую итерацию. Перевод считается завершенным при , равном специальному токену end.

Применение механизма внимания для Seq2seq

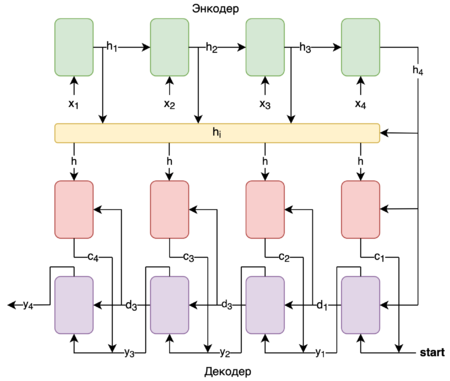

При добавлении механизма в данную архитектуру между RNN Энкодер и Декодер слоя механизма внимания получится следуюшая схема:

Здесь имееют те же назначения, что и в варианте без механизма внимания.

Аггрегатор скрытых состояний энкодера (желтый) — аггрегирует в себе все вектора и возвращает всю последовательность векторов .

— вектор контекста на итерации .

Блоки механизма внимания (красный) — механизм внимания. Принимает и , возвращает .

Блоки декодера (фиолетовый) — по сравнению с обычной Seq2seq сетью меняются входные данные. Теперь на итерации на вход подается не , а конкатенация и .

Таким образом при помощи механизма внимания достигается "фокусирование" декодера на определенных скрытых состояниях. В случаях машинного перевода эта возможность помогает декодеру предсказывать на какие скрытые сосояния при исходных определенных словах на языке A необходимо обратить больше внимания при переводе данного слова на язык B.

Self-Attention

TODO

См. также

Источники информации

- Лекция Andrew Ng о механизме внимания в NLP

- Статья с подробно разборанными примерами и кодом на Python и TensorFlow