Синтез речи — различия между версиями

Evaleria (обсуждение | вклад) м (→Алгоритмы, основанные на нейронных сетях) |

м (rollbackEdits.php mass rollback) |

| (не показана 1 промежуточная версия 1 участника) | |

(нет различий)

| |

Текущая версия на 19:36, 4 сентября 2022

Синтез речи (англ. speech synthesis) — процесс генерации компьютером человеческой речи. Компьютерная система, способная к синтезу речи, называется речевым синтезатором. Система, генерирующая человеческую речь, основываясь на тексте, называется text-to-speech системой (сокр. TTS).

В процессе человеческой речи нервная система транслирует некоторый текст или мысленный концепт в движение мышц, связанных с органами дыхания и речи. Затем производится генерация акустического сигнала с помощью потока воздуха из легких. Сигнал содержит как периодические компоненты (созданные с помощью вибрации органов речи), так и апериодические (созданные окружающей средой и фоновым шумом). Используя изменяющиеся во времени сокращения мышц, меняются частотные характеристики акустического сигнала. Задача систем генерации речи по тексту — симулировать данный процесс в каком-либо виде.

Содержание

Этапы синтеза речи

Работу систем синтеза речи по тексту как правило можно разделить на два этапа, за которые отвечают два отдельных компонента — обработка текста и синтез речи.

Первый этап обычно содержит несколько этапов обработки естественного языка, такие как разбиение на предложения, разбиение на слова, нормализация текста, автоматическая морфологическая разметка и конвертация графем в фонемы (англ. grapheme-to-phoneme conversion, G2P). Данный этап принимает в качестве входных параметров текст и возвращает последовательность фонем с различными выделенными лингвистическими особенностями.

Этап синтеза речи, в свою очередь, принимает на вход последовательность фонем и возвращает синтезированную звуковую волну речи. Данный этап обычно включает в себя алгоритмы предсказания просодии — характеристик речи, описывающих признаки, являющиеся дополнительными к основной артикуляции звука, такие как тон, ударение, громкость и т.д.

Генерация звуковой волны

Обычно, синтезаторы речи не работают непосредственно с сигналом звуковой волны, а используют некоторое представление этого сигнала, например, спектрограмму. Алгоритм, способный выделить такие параметры и по ним обратно восстановить звуковую волну, называется вокодер (англ. voice encoder). Примерами таких алгоритмов являются мю-закон [1] и восстановление сигнала по его спектрограмме.

Мю-закон преобразует каждое значение дискретизированного сигнала как

,

где и , а затем кодирует сигнал как двузначное шестнадцатеричное число, которое обозначает некоторый интервал на числовой прямой[1]. Обратное преобразование выбирает значение преобразованного сигнала из данного номера интервала и получает оценку исходного сигнала следующим образом:

.

В качестве представления звукового сигнала может выступать спектрограмма волны — изображение, показывающее зависимость спектральной плотности мощности сигнала от времени. Спектрограммы отображают частоту и амплитуду сигнала во времени, но не содержат никакой информации о фазе сигнала, из-за чего результат обратного восстановления сигнала по спектрограмме неизбежно отличается от оригинала. Цифровая генерация спектрограммы сигнала сводится к вычислению квадрата амплитуды оконного преобразования Фурье:

,

где — используемое окно и — оконное преобразование Фурье.

Для восстановления исходного сигнала по его спектрограмме может быть использован алгоритм Гриффина-Лима[2], который основан на минимизации среднеквадратичной ошибки между оконным преобразованием Фурье оцениваемого сигнала и имеющимся преобразованием в спектрограмме.

Классы подходов к синтезу речи

Основными требованиями к технологиям синтеза речи являются естественность (англ. naturalness) и разборчивость (англ. intelligibility). Естественность описывает, насколько генерируемая речь близка к человеческой, а разборчивость отражает, насколько сложно понять речь. Идеальный синтезатор речи генерирует одновременно и натуральную, и разборчивую речь.

Конкатенативный синтез

Конкатенативный синтез (англ. concatenative synthesis) основывается на конкатенации предварительно записанных примеров человеческой речи в единую звуковую последовательность. Данный подход синтезирует наиболее естественную речь, но генерируемая речь часто содержит значительные отличия и ошибки по сравнению с человеческой речью. Примеры конкатенативного синтеза:

- Синтез с выбором (англ. unit selection synthesis) является самым используемым подходом конкатенативного синтеза и использует большую базу данных записанной речи. При создании базы данных записанные фразы могут делиться на различные звуковые единицы, такие, как фоны, дифоны, полуфоны, слоги, морфемы, целые фразы или предложения. При запуске алгоритм генерирует выходную звуковую волну с помощью выбора наилучшей последовательности звуковых единиц из базы данных. Данный выбор обычно реализован с помощью дерева решений. Синтез с выбором обеспечивает наиболее естественную речь, так как использует минимальную цифровую обработку сигналов. Недостатком подхода является необходимость в довольно большой базе данных звуков для достижения наибольшей естественности речи. Данный подход являлся самым популярным для общего класса задач синтеза речи, но в последнее время уступает по популярности параметрическому подходу. Примером использования синтеза с выбором является голосовой помощник Siri от Apple [3] и голосовой помощник Алиса от компании Яндекс [4]. Несмотря на то, что эти продукты используют глубокое обучение, их механизм синтеза речи основан на записанных примерах голоса.

- Дифонный синтез (англ. diphone synthesis) является частным случаем синтеза с выбором, который использует в качестве звуковых единиц дифоны (переход от звука к звуку). Подход использует только один образец каждого дифона. База данных дифонов при этом получается сравнительно небольшой. Например, немецкий язык содержит около 800 дифонов, а испанский — около 2500. При работе алгоритма просодия входной последовательности накладывается на дифоны в базе данных с помощью различных алгоритмов цифровой обработки сигналов. Данный алгоритм значительно уступает по качеству другим подходам и кроме меньшего размера базы данных не дает весомых преимуществ, из-за чего не снискал большой популярности.

- Синтез речи, ограниченный предметной областью (англ. domain-specific speech synthesis) также является частным случаем синтеза с выбором и использует базу данных предварительно записанных слов, фраз и предложений для составления выходной последовательности. Он используется в задачах, где вариативность и размер используемых фраз ограничены некоторой предметной областью, например, прогнозирование погоды или составление расписания транспорта. Из-за значительной простоты реализации и использования данный подход уже долго применяется в коммерческих продуктах, например, говорящие часы или калькуляторы. При этом данный подход может обеспечивать высокую естественность речи вследствие ограниченности используемой базы данных. Недостатками таких систем является ограниченность областью применимости и неспособность учитывать контекст речи, что может вызывать ощутимые ошибки в некоторых языках.

Параметрический синтез

Параметрический синтез (англ. statistical parametrical synthesis) для генерации выходной звуковой волны, в отличии от конкатенативного синтеза, не использует реальные примеры речи, а строит вероятностное распределение некоторых параметров и акустических свойств звуковой волны. В начале работы параметрического синтезатора с помощью вокодера извлекаются параметры звуковой волны и лингвистические данные из текста, который необходимо озвучить. Конкретный вид вектора зависит от используемого вокодера — это может быть как спектрограмма волны, так и некоторое другое представление сигнала, например, дискретные номера интервалов числовой прямой, получаемые с помощью мю-закона. Затем, порождающая модель, например, скрытая марковская цепь, нейронная сеть прямого распространения или рекуррентная нейронная сеть, обучается по выделенным параметрам и , получая параметры модели , наиболее хорошо описывающие распределение . На этапе синтеза, модель генерирует наиболее правдоподобные параметры звуковой волны, используя найденные на этапе обучения параметры модели и лингвистическую информацию текста, который необходимо озвучить:

.

Выходная звуковая волна генерируется вокодером на основе найденных параметров .

Данный подход является самым популярным на сегодняшний момент, в том числе из-за того, что он позволяет использовать подходы, основанные на нейронных сетях. Современными продуктами, использующие основанный на глубоком обучении параметрический синтез являются Amazon Lex и Alexa [5], Google Ассистент [6] и умные дисплеи Portal от Facebook [7].

Алгоритмы, основанные на нейронных сетях

Рассмотрим две популярные сети для преобразования текста в спектрограмму (Tacotron) и для синтеза речи по спектрограмме (WaveNet). Для синтеза речи по спектрограмме предложено множество моделей: авторегрессионныее (WaveNet, WaveRNN, LPCNet), неавторегресионные (WaveGlow, MelGAN, WaveGrad) и разнообразные (например, можно натренировать сети GAN для генерации лиц под задачу генерации спектрограммы).

Tacotron

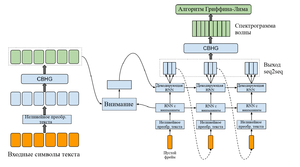

Tacotron — модель[8] параметрического синтеза речи, основанная на подходе seq2seq, разработанная Google и опубликованная в 2017 году. Модель состоит из кодера, декодера с вниманием и нейронной сети для пост-процессинга сигнала. Схема модели изображена на Рисунке 1.

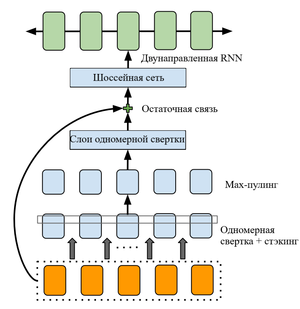

Кодер и сеть пост-процессинга опираются на блок CBHG, схема которого изображена на Рисунке 2. Блок состоит из набора одномерных сверточных фильтров, за которыми следуют шоссейные нейронные сети (англ. highway networks)[9], являющиеся модификацией LSTM сетей, и двунаправленный управляемый рекуррентный блок. Входная последовательность сначала обрабатывается наборами сверточных фильтров с размерностью . Эти фильтры моделируют локальную и контекстно-зависимую информацию (по аналогии с моделированием униграмм, биграмм, вплоть до -грамм). Выход сверточного уровня далее обрабатывается шоссейной сетью для дальнейшего выделения параметров. В конце CBHG используется управляемый рекуррентный блок, который для выделения параметров опирается на контекст перед рассматриваемым символом и после рассматриваемого символа.

Задача кодера заключается в извлечении последовательных параметров из текста. Его входом является последовательность символов, в которой каждый символ был закодирован one-hot кодированием и объединен в единый непрерывный вектор. К данному входу применяется ряд нелинейных преобразований в виде сети с бутылочным горлышком (англ. bottleneck layer), что позволяет улучшить обобщаемость сети и ускорить сходимость. Модуль CBHG преобразует выход нелинейных преобразований в итоговое представление текста, которая передается в декодер.

Декодер является рекуррентной нейронной сетью с вниманием, в которой запрос внимания генерируется каждый временной промежуток. Вектор контекста соединяется с выходом ячейки внимания и подается на вход декодирующим рекуррентным нейронным сетям, которые являются управляемыми рекуррентными блоками. Выходом декодера является спектрограмма звуковой волны, которая передается сети пост-обработки для генерации непосредственно звуковой волны.

В качестве сети пост-обработки используется модуль CBHG, описанный ранее. После этого спектрограмма звуковой волны передается на вход алгоритму Гриффина-Лима, который генерирует итоговую звуковую волну.

Модель Tacotron была значительно улучшена в последующей модификации Tacotron 2 [10], которая переработала исходную архитектуру Tacotron и объединила её с вокодером на основе WaveNet. Данная модель способна синтезировать речь высокого качества, принимая на вход только текст, который необходимо озвучить[11]. Реализация данной модели доступна на Github.

WaveNet

WaveNet[12] является порождающей моделью, использующей параметрический подход к синтезу речи. Её задача — восстановить распределение вероятностей звукового сигнала с помощью произведения условных вероятностей:

.

Таким образом, вероятность каждого сигнала зависит только от предыдущих сигналов. Во время обучения модель оценивает данное условное распределение вероятностей, принимая на вход сигналы из обучающей выборки одновременно. На этапе генерации модель порождает выходные сигналы с помощью полученной оценки распределения вероятности последовательно — полученный моделью сигнал в момент времени подается обратно на вход для генерации последующего сигнала в момент времени . Структура модели позволяет использовать её в широком спектре задач, например, в задачах продолжения музыкального произведения по его началу, порождения голоса конкретного человека или text-to-speech синтеза.

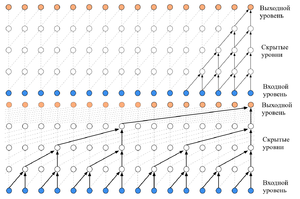

Основной идеей модели является использование причинных сверточных сетей (англ. causal convolution layers) и расширенных причинных сверточных сетей (англ. dilated causal convolution layers). Причинная сверточная сеть представляет собой несколько уровней сверточной нейронной сети, связанных между собой в порядке, который не нарушает последовательность входного сигнала, т.е. оцениваемая в момент времени вероятность сигнала не зависит от сигналов в последующие моменты времени . Причинные сверточные сети обучаются быстрее, чем рекуррентные нейронные сети, но требуют достаточно большого количества уровней для обеспечивания большого окна восприятия сигнала (англ. signal reception window) — количество предыдущих сигналов, от которых зависит оценка сигнала в текущий момент.

Модификация причинных сверточных сетей, расширенные причинные сверточные сети, способна увеличить окно восприятия сигнала в разы и является основной идеей модели WaveNet. Модификация заключается в применении свертки к области размерности большей, чем её длина, пропуская входные связи с некоторым шагом. Данный подход аналогичен применению пулинга или свертки с шагом большим единицы, но выходом расширенной причинной сверточной сети является последовательность размерности, равной размерности входной последовательности. Расширенные причинные сверточные сети способны достигать большего окна восприятия сигнала, используя меньшее количество уровней, при этом сохраняя вычислительную сложность причинных сверточных сетей. Структура причинных сверточных сетей изображена на Рисунке 3.

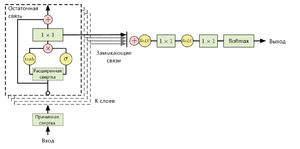

Полная структура модели WaveNet изображена на Рисунке 4. В качестве вокодера используется мю-закон. Модель представляет собой множество слоев сверточной нейронной сети, аналогично модели PixelCNN. Модель на вход принимает закодированную мю-законом последовательность сигналов и, опционально, некоторую дополнительную информацию, обозначаемую как вектор параметров , а на выходе возвращает распределение вероятностей для параметров мю-закона, по которым можно восстановить синтезированный сигнал. На этапе обучения входным сигналом является пример звука из обучающей выборки, который подается на все входы одновременно. На этапе генерации входом модели будут являться сигналы, порожденные ею в предыдущие моменты времени и передаваемые ей последовательно. Дополнительная информация , например, может содержать информацию о рассматриваемом тексте в задаче text-to-speech синтеза.

Модель представляет собой набор из блоков с остаточной связью, содержащих преобразование расширенной причинной свертки и функцию активации. Функция активации при этом аналогична функции, предложенной в модели Gated PixelCNN [13]:

,

где — номер слоя модели, — индексы входов преобразования, — функция сигмоиды, — операция свертки, — операция покомпонентного умножения векторов и — выученные параметры свертки.

В случае использования дополнительной информации модель оценивает распределение вероятностей звукового сигнала как:

.

Для использования дополнительной информации функция активации может использовать вектор глобально при вычислении каждой свертки как:

,

где — выученные параметры линейной проекции. В случае, когда размерность вектора меньше, чем размерность , можно использовать upsampling-преобразование сверточных сетей, чтобы получить вектор размерности и использовать его вместо оригинального вектора . При этом будет являться операцией свертки размера 1.

Самый известный пример применения WaveNet для синтеза речи является технология Google Ассистент, которая использует WaveNet для генерации голосов ассистентов на различных языках. Модель позволила значительно сократить количество записей речи актеров озвучки, требуемых для создания голосовой модели[6].

Проблемы

Задача обработки текста

Алгоритмы обработки текста могут не справляться с обработкой определенных частей речи, таких, как аббревиатуры, числа и гетеронимы. Произношение определенных слов также зависит от контекста их применения. Большинство систем синтеза речи по тексту не способны выделять контекст предложений и используют различные эвристические подходы с целью различить омографы (слова с одинаковым написанием, но различным произношением).

Преобразование текста в фонемы

Процесс преобразования текста в фонемы обычно подразделяется на два подхода — словарный и основанный на правилах. Словарный подход использует словарь с записанными фонетическими представлениями слов и в процессе работы производит поиск в нем с целью конвертации слова в последовательность фонем. Основанный на правилах подход использует набор правил, которые применяются к словам или частям слов с целью выделения фонем. Оба эти подхода имеют существенные недостатки и требуют усовершенствования.

Мультиязычный синтез

Работает, но интересная задача генерации данного голоса на другом языке.

Несколько голосов

Сеть перепрыгивает между голосами в середине слова.

Синтез в стиле

Сейчас реализовано с помощью вариационных автоэнкодеров. Требуется пример для стиля.

Выразительный синтез

Непонятно, что речь должна отмечать выражением.

Оценка качества

На данный момент не существует единых критериев оценки качества синтезаторов речи. В каждом отдельном применении технологии синтеза речи могут быть в том числе свои критерии качества, связанные с предметной областью или используемым оборудованием. С другой стороны, ряд исследователей начали оценивать синтезаторы речи используя распространенные наборы данных для синтеза речи [14].

Популярной метрикой оценки естественности речи является средняя оценка мнения (англ. mean opinion score)[15]. Она заключается в воспроизведении результатов работы синтезатора речи выборке людей, которые затем оценивают её качество по шкале от 1 до 5, в которой 1 означает "плохое" качество, 5 — "идеальное". Итоговой оценкой является среднее арифметическое всех оценок. Данная метрика страдает от субъективности и предвзятости опрашиваемых людей, в частности, в подобного рода экспериментах опрашиваемые стремятся ставить оценки, располагающиеся на всей ширине интервала оценок[16]. Из этого следует, что данная оценка не является абсолютной и её нельзя использовать для сравнения двух отдельных экспериментов кроме тех случаев, когда эксперимент поставлен особым образом, чтобы учесть данный недостаток, и даже в таком случае требуется статистический анализ данных, чтобы убедиться, что такое сравнение двух систем корректно[15].

Модели WaveNet, Tacotron и Tacotron 2 использовали среднюю оценку мнения для сравнения своей работы с естественным языком и другими подходами. Например, WaveNet достиг оценки 4.21 и 4.08 для американского варианта английского и путунхуа, по сравнению с оценками естественного языка 4.46 и 4.25 соответственно. Работа, описывающая модель Tacotron, сравнивала модель с другими разрабатываемыми подходами[17][18]. Tacotron смог достичь оценки в 3.82 балла для американского варианта английского, когда параметрический подход достиг 3.69, а конкатенативный - 4.09. Tacotron 2 смог достичь оценки в 4.52 балла по сравнению с оценкой записанной речи в 4.58 балла[11].

См. также

- Нейронные сети, перцептрон

- Сверточные нейронные сети

- Рекуррентные нейронные сети

- Механизм внимания

- Распознавание речи

Примечания

- ↑ 1,0 1,1 "ITU-T Recommendation G.711"

- ↑ D. Griffin and Jae Lim, "Signal estimation from modified short-time Fourier transform," ICASSP '83. IEEE International Conference on Acoustics, Speech, and Signal Processing, Boston, Massachusetts, USA, 1983, pp. 804-807, doi: 10.1109/ICASSP.1983.1172092.

- ↑ Deep Learning for Siri’s Voice: On-device Deep Mixture Density Networks for Hybrid Unit Selection Synthesis.

- ↑ Optimization 2018: что находится «под капотом» у Алисы.

- ↑ Bringing the Magic of Amazon AI and Alexa to Apps on AWS.

- ↑ 6,0 6,1 Martin, Taylor (May 9, 2018)."Try the all-new Google Assistant voices right now". CNET.

- ↑ Facebook’s voice synthesis AI generates speech in 500 milliseconds.

- ↑ 8,0 8,1 8,2 Yuxuan Wang, RJ Skerry-Ryan, Daisy Stanton, Yonghui Wu, Ron J. Weiss, Navdeep Jaitly, Zongheng Yang, Ying Xiao, Zhifeng Chen, Samy Bengio, Quoc Le, Yannis Agiomyrgiannakis, Rob Clark, & Rif A. Saurous. (2017). Tacotron: Towards End-to-End Speech Synthesis. arXiv:1703.10135

- ↑ Rupesh Kumar Srivastava, Klaus Greff, and J ̈urgen Schmidhuber. Highway networks. arXiv:1505.00387, 2015.

- ↑ Jonathan Shen, Ruoming Pang, Ron J. Weiss, Mike Schuster, Navdeep Jaitly, Zongheng Yang, Zhifeng Chen, Yu Zhang, Yuxuan Wang, RJ Skerry-Ryan, Rif A. Saurous, Yannis Agiomyrgiannakis, & Yonghui Wu. (2018). Natural TTS Synthesis by Conditioning WaveNet on Mel Spectrogram Predictions. arXiv:1712.05884.

- ↑ 11,0 11,1 Tacotron 2: Generating Human-like Speech from Text

- ↑ 12,0 12,1 12,2 Aaron van den Oord, Sander Dieleman, Heiga Zen, Karen Simonyan, Oriol Vinyals, Alex Graves, Nal Kalchbrenner, Andrew Senior, & Koray Kavukcuoglu. (2016). WaveNet: A Generative Model for Raw Audio. arXiv:1609.03499

- ↑ Aaron van den Oord, Nal Kalchbrenner, Oriol Vinyals, Lasse Espeholt, Alex Graves, & Koray Kavukcuoglu. (2016). Conditional Image Generation with PixelCNN Decoders. arXiv:1606.05328

- ↑ Blizzard Challenge

- ↑ 15,0 15,1 ITU-T Recommendation P.800.2 : Mean opinion score interpretation and reporting

- ↑ Zielinski, Slawomir, Francis Rumsey, and Søren Bech. "On some biases encountered in modern audio quality listening tests-a review." Journal of the Audio Engineering Society 56.6 (2008): 427-451.

- ↑ Heiga Zen, Yannis Agiomyrgiannakis, Niels Egberts, Fergus Henderson, and Przemysław Szczepa-niak. Fast, compact, and high quality LSTM-RNN based statistical parametric speech synthesizersfor mobile devices.Proceedings Interspeech, 2016

- ↑ Junyoung Chung, Caglar Gulcehre, KyungHyun Cho, and Yoshua Bengio. Empirical evaluation ofgated recurrent neural networks on sequence modeling. arXiv:1412.3555, 2014.

Источники информации

- Aaron van den Oord, Sander Dieleman, Heiga Zen, Karen Simonyan, Oriol Vinyals, Alex Graves, Nal Kalchbrenner, Andrew Senior, & Koray Kavukcuoglu. (2016). WaveNet: A Generative Model for Raw Audio. arXiv:1609.03499

- Yuxuan Wang, RJ Skerry-Ryan, Daisy Stanton, Yonghui Wu, Ron J. Weiss, Navdeep Jaitly, Zongheng Yang, Ying Xiao, Zhifeng Chen, Samy Bengio, Quoc Le, Yannis Agiomyrgiannakis, Rob Clark, & Rif A. Saurous. (2017). Tacotron: Towards End-to-End Speech Synthesis. arXiv:1703.10135