Дерево решений и случайный лес — различия между версиями

Sokolova (обсуждение | вклад) (→Алгоритмы построения деревье решения) |

Sokolova (обсуждение | вклад) (→Композиции решающих деревьев) |

||

| Строка 125: | Строка 125: | ||

== Композиции решающих деревьев == | == Композиции решающих деревьев == | ||

| − | === | + | Для повышения точности модели применяют объединения моделей (классификаторов) в ансамбль. |

| + | ===Способы построения ансамблей=== | ||

| + | * Бустинг (англ. ''boosting'') | ||

| + | При бустинге происходит последовательное обучение классификаторов. Таким образом, обучающий набор данных на каждом последующем шаге зависит от точности прогнозирования предыдущего базового классификатора. Первый алгоритм Boost1, например, применял три базовых классификатора. При этом первый классификатор обучался на всем наборе данных, второй на выборке примеров, а третий – на наборе тех данных, где результаты прогнозирования первых двух классификаторов разошлись. Современная модификация первого алгоритма подразумевает использование неограниченного количества классификаторов, каждый из которых обучается на одном наборе примеров, поочередно применяя их на различных шагах. | ||

| + | * Бэггинг | ||

| + | В отличие от предыдущего метода, бэггинг (bootstrap aggregating) использует параллельное обучение базовых классификаторов (говоря языком математической логики, бэггинг – улучшающее объединение, а бустинг – улучшающее пересечение). В ходе бэггинга происходит следующее: | ||

| + | |||

| + | Из множества исходных данных случайным образом отбирается несколько подмножеств, содержащих количество примеров, соответствующее количеству примеров исходного множества. | ||

| + | Поскольку отбор осуществляется случайным образом, то набор примеров всегда будет разным: некоторые примеры попадут в несколько подмножеств, а некоторые не попадут ни в одно. | ||

| + | На основе каждой выборки строится классификатор. | ||

| + | Выводы классификаторов агрегируются (путем голосования или усреднения). | ||

== Пример использования (через scikit-learn) == | == Пример использования (через scikit-learn) == | ||

Версия 22:21, 20 января 2019

Содержание

Дерево решений

| Определение: |

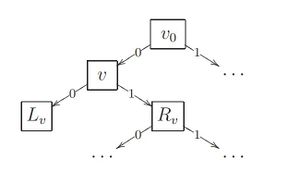

Дерево решений (англ. decision tree, DT) — алгоритм классификации , задающийся деревом (связным ациклическим графом):

|

| Определение: |

Бинарное дерево решений — частный случай дерева решений, для которого .

|

function classify(x): if then else return

Рекурсивный алгоритм построения бинарного дерева решений ID3

Идея алгоритма (англ. Induction of Decision Tree) заключается в последовательном дроблении выборки на две части до тех пор, пока в каждой части не окажутся объекты только одного класса. Разделение производится по предикату , который выбирается из множества элементарных предикатов. На практике в качестве элементарных предикатов чаще всего берут простые пороговые условия вида .

Проще всего записать этот алгоритм в виде рекурсивной процедуры , которая строит дерево по заданной подвыборке и возвращает его корневую вершину.

1:function ID3(): 2: if все объекты множества принадлежат одному классу then 3: создать новый лист 4: 5: return v 6: найти предикат с максимальной информативностью : Gain(, ) 7: разбить выборку на две части по предикату : 8: if или then 9: создать новый лист 10: = класс, в котором находится большинство объектов из 11: else 12: создать новую внутреннюю вершину 13: 14: = ID3() 15: = ID3() 16: return

Информативность ветвления

| Определение: |

| Частотная оценка вероятности класса в вершине : |

| Определение: |

Мера неопределенности (англ. impurity) распределения :

где убывает и , например: , , |

Примеры:

- Энтропия:

- Критерий Джини:

| Определение: |

| Неопределенность распределения после ветвления вершины по предикату и разбиения : |

| Определение: |

| Информационный выигрыш от ветвления вершины |

Рецукция решающих деревьев

Суть редукции состоит в удалении поддеревьев, имеющих недостаточную статистическую надёжность. При этом дерево перестаёт безошибочно классифицировать обучающую выборку, зато качество классификации новых объектов, как правило, улучшается. Рассмотрим наиболее простые варианты редукции.

Предредукция

Предредукция (англ. pre-pruning) или критерий раннего останова досрочно прекращает дальнейшее ветвление в вершине дерева, если информативность для всех возможных предикатов не дотягивает до заданного порогового значения .

Для этого на шаге 8 алгоритма условие или заменяется условием . Порог является управляющим параметром метода.

Предредукция считается не самым эффективным способом избежать переобучения, так как жадное ветвление по-прежнему остаётся глобально неоптимальным. Более эффективной считается cтратегия постредукции.

Постредукция

Постредукция (англ. post-pruning) просматривает все внутренние вершины дерева и заменяет отдельные вершины либо одной из дочерних вершин (при этом вторая дочерняя удаляется), либо терминальной вершиной. Процесс замен продолжается до тех

пор, пока в дереве остаются вершины, удовлетворяющие критерию замены.

Критерием замены является сокращение числа ошибок на контрольной выборке, отобранной заранее, и не участвовавшей в обучении дерева. Стандартная рекомендация — оставлять в контроле около 30% объектов.

Для реализации постредукции контрольная выборка пропускается через

построенное дерево. При этом в каждой внутренней вершине запоминается подмножество попавших в неё контрольных объектов. Если , то вершина считается ненадёжной и заменяется терминальной по мажоритарному правилу:

в качестве берётся тот класс, объектов которого больше всего в обучающей подвыборке , пришедшей в вершину .

Затем для каждой внутренней вершины вычисляется число ошибок, полученных при классификации выборки следующими способами:

- — классификация поддеревом, растущим из вершины ;

- — классификация поддеревом левой дочерней вершины ;

- — классификация поддеревом правой дочерней вершины ;

- — отнесение всех объектов выборки к классу .

Эти величины сравниваются, и, в зависимости от того, какая из них оказалась

минимальной, принимается, соответственно, одно из четырёх решений:

- сохранить поддерево вершины ;

- заменить поддерево вершины поддеревом левой дочерней вершины ;

- заменить поддерево вершины поддеревом правой дочерней вершины ;

- заменить поддерево терминальной вершиной класса .

Алгоритмы построения деревьев решения

- Алгоритм ID3

- Алгоритм C4.5

- Алгоритм CART

- Алгоритм LISTBB

Композиции решающих деревьев

Для повышения точности модели применяют объединения моделей (классификаторов) в ансамбль.

Способы построения ансамблей

- Бустинг (англ. boosting)

При бустинге происходит последовательное обучение классификаторов. Таким образом, обучающий набор данных на каждом последующем шаге зависит от точности прогнозирования предыдущего базового классификатора. Первый алгоритм Boost1, например, применял три базовых классификатора. При этом первый классификатор обучался на всем наборе данных, второй на выборке примеров, а третий – на наборе тех данных, где результаты прогнозирования первых двух классификаторов разошлись. Современная модификация первого алгоритма подразумевает использование неограниченного количества классификаторов, каждый из которых обучается на одном наборе примеров, поочередно применяя их на различных шагах.

- Бэггинг

В отличие от предыдущего метода, бэггинг (bootstrap aggregating) использует параллельное обучение базовых классификаторов (говоря языком математической логики, бэггинг – улучшающее объединение, а бустинг – улучшающее пересечение). В ходе бэггинга происходит следующее:

Из множества исходных данных случайным образом отбирается несколько подмножеств, содержащих количество примеров, соответствующее количеству примеров исходного множества. Поскольку отбор осуществляется случайным образом, то набор примеров всегда будет разным: некоторые примеры попадут в несколько подмножеств, а некоторые не попадут ни в одно. На основе каждой выборки строится классификатор. Выводы классификаторов агрегируются (путем голосования или усреднения).

Пример использования (через scikit-learn)

Ссылки

- Classification and Regression Trees — лекции Cosma Shalizi, ноябрь 2009.