Марковская цепь — различия между версиями

| Строка 14: | Строка 14: | ||

Такая матрица называется ''стохастической''. | Такая матрица называется ''стохастической''. | ||

| − | Для марковской цепи задают вектор-строку <tex> c_0 </tex>, где <tex>\ c_{ | + | Для марковской цепи задают вектор-строку <tex> c_0 </tex>, где <tex>\ c_{0j} </tex> — вероятность того, что в начале процесса марковская цепь находится в состоянии <tex> j </tex>. Если <tex> c_i </tex> — текущее распределение вероятностей, то можно узнать распределение на следующем шаге, умножив вектор на матрицу перехода: |

| − | <tex> | + | <tex> c_{i + 1} = c_{i} \times P </tex>. |

| − | Для того, чтобы узнать распределение вероятностей через <tex> t </tex> шагов, | + | Для того, чтобы узнать распределение вероятностей через <tex> t </tex> шагов, нужно умножить <tex> c_0 </tex> на матрицу перехода, возведённую в степень <tex> t </tex>: |

| − | <tex> | + | <tex> c_{i + t} = c_{i} \times P^t </tex>. |

| + | |||

| + | Соответственно, можно найти распределение вероятностей на любом шаге, зная лишь начальное распределение вероятностей: | ||

| + | |||

| + | <tex> c_i = c_0 \times P^t </tex>. | ||

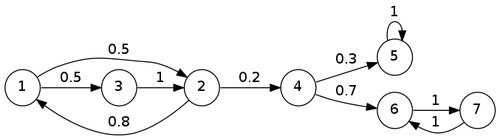

Марковскую цепь можно представить в виде графа, в котором вершины — это состояния процесса, а ребра — переходы между состояниями, и на ребре из <tex> i </tex> в <tex> j </tex> написана вероятность перехода из <tex> i </tex> в <tex> j </tex>, то есть <tex> p_{ij} </tex>. | Марковскую цепь можно представить в виде графа, в котором вершины — это состояния процесса, а ребра — переходы между состояниями, и на ребре из <tex> i </tex> в <tex> j </tex> написана вероятность перехода из <tex> i </tex> в <tex> j </tex>, то есть <tex> p_{ij} </tex>. | ||

Версия 14:17, 10 марта 2012

| Определение: |

| Цепь Маркова — процесс, находящийся в одном из состояний.

При этом, если он находится в состоянии с номером , то он перейдет в состояние с вероятностью . Матрицу называют матрицей переходов. |

На матрицу переходов накладываются следующие условия:

Такая матрица называется стохастической.

Для марковской цепи задают вектор-строку , где — вероятность того, что в начале процесса марковская цепь находится в состоянии . Если — текущее распределение вероятностей, то можно узнать распределение на следующем шаге, умножив вектор на матрицу перехода:

.

Для того, чтобы узнать распределение вероятностей через шагов, нужно умножить на матрицу перехода, возведённую в степень :

.

Соответственно, можно найти распределение вероятностей на любом шаге, зная лишь начальное распределение вероятностей:

.

Марковскую цепь можно представить в виде графа, в котором вершины — это состояния процесса, а ребра — переходы между состояниями, и на ребре из в написана вероятность перехода из в , то есть .

Содержание

Достижимость и сообщаемость

Обозначим вероятность попасть из состояния в состояние за переходов как .

| Определение: |

| Состояние достижимо (accesible) из состояния , если существует такое , что . Достижимость из обозначается . |

| Определение: |

| Состояния и сообщаются (communicate), если они достижимы друг из друга. |

Классификация цепей и состояний

Неразложимая цепь

| Определение: |

| Неразложимый класс (communicating class) — класс эквивалентности множества состояний по отношению сообщаемости. Если представить марковскую цепь как граф, неразложимый класс будет аналогичен компоненте сильной связности. |

| Определение: |

| Неразложимая цепь (ireducible chain) — цепь Маркова, в которой все состояния образуют один неразложимый класс. |

Эргодическая цепь

| Определение: |

| Упорядочим (очевидно, упорядочение будет частичным) неразложимые классы отношением достижимости. Минимальные элементы в таком упорядочении называются эргодическими классами. Состояния в эргодических классах называются эргодическими (ergodic), возвратными, или существенными. Все остальные неразложимые классы называются невозвратными классами. Состояния, входящие в них, называются невозвратными или несущественными. |

| Определение: |

| Если эргодический класс состоит из одного состояния, такое состояние называется поглощающим (absorbing). |

Из свойств частичного упорядочения, в любой цепи Маркова найдется хотя бы один эргодический класс.

| Определение: |

| Эргодическая марковская цепь — марковская цепь, целиком состоящая из одного эргодического класса. |

| Определение: |

| В эргодической цепи можно выделить циклические классы. Количество циклических классов называют периодом цепи, если цепь состоит целиком из одного циклического класса, её называют регулярной. С течением времени текущее состояние движется по циклическим классам в определенном порядке, причем каждые d шагов она оказывается в одном и том же циклическом классе. |

Таким образом, эргодические цепи делятся на регулярные и циклические.

Поглощающая цепь

| Определение: |

| Поглощающей (absorbing chain) называется марковская цепь, в которой есть хотя бы одно поглощающее состояние и из любого состояния достижимо хотя бы одно поглощающее. |

В примере на рисунке поглощающими являются состояния 3 и 4, а непоглощающими — 1 и 2.

Пример

На рисунке:

- достижимыми состояниями являются: из , из , из и т.д., сообщаются и , а также и ;

- неразложимыми классами являются множества вершин , , , ;

- эргодическими классами являются множества вершин , ;

- поглощающим состоянием является состояние .

Литература

- И.В. Романовский «Дискретный анализ». 3-е изд., 2003. стр. 270—279

- Дж. Кемени, Дж. Снелл "Конечные цепи Маркова"

- Цепь Маркова