Переобучение — различия между версиями

({{---}}) |

Rugpanov (обсуждение | вклад) (Добавить ссылки) |

||

| Строка 38: | Строка 38: | ||

* Использование для описания модели функций с более высокой степенью | * Использование для описания модели функций с более высокой степенью | ||

* Уменьшение коэффициента регуляризации | * Уменьшение коэффициента регуляризации | ||

| + | |||

| + | == См. также == | ||

| + | * [http://neerc.ifmo.ru/wiki/index.php?title=Модель_алгоритма_и_ее_выбор Модель алгоритма и ее выбор]<sup>[на 01.12.18 не создан]</sup> | ||

| + | * [http://neerc.ifmo.ru/wiki/index.php?title=Оценка_качества_в_задачах_классификации_и_регрессии Оценка качества в задачах классификации и регрессии ]<sup>[на 01.12.18 не создан]</sup> | ||

| + | * [http://neerc.ifmo.ru/wiki/index.php?title=Оценка_качества_в_задаче_кластеризации Оценка качества в задаче кластеризации ]<sup>[на 01.12.18 не создан]</sup> | ||

| + | |||

| + | == Примечания == | ||

| + | * [http://blog.lokad.com/journal/2009/4/22/overfitting-when-accuracy-measure-goes-wrong.html Overfitting: when accuracy measure goes wrong] | ||

| + | * [http://www3.cs.stonybrook.edu/~skiena/jaialai/excerpts/node16.html The Problem of Overfitting Data] | ||

| + | * [https://elitedatascience.com/overfitting-in-machine-learning Overfitting in Machine Learning] | ||

| + | |||

| + | == Источники информации == | ||

| + | * [https://en.wikipedia.org/wiki/Overfitting Overfitting] - статься на Википедии | ||

| + | * [http://www.machinelearning.ru/wiki/index.php?title=Переобучение Переобучение] - вводная статься на MachineLearning.ru | ||

| + | * [https://www.coursera.org/lecture/machine-learning/the-problem-of-overfitting-ACpTQ The Problem of Overfitting] - курс Andrew Ng | ||

Версия 18:17, 1 декабря 2018

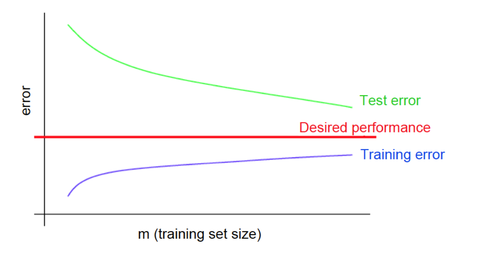

Переобучение (англ. overfitting, high variance) — негативное явление возникающее, когда величина средней ошибки обученного алгоритма на объектах тестовой выборки оказывается существенно выше, чем величина средней ошибки на обучающей выборке. Переобучение возникает при использовании избыточно сложных моделей.

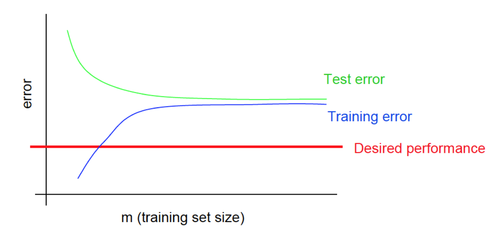

Недообучение (англ. underfitting, high bias) — негативное явление возникающее, когда алгоритм обучения не обеспечивает достаточно малой величины средней ошибки на обучающей выборке. Недообучение возникает при использовании недостаточно сложных моделей.

Содержание

Примеры

На примере линейной регрессии

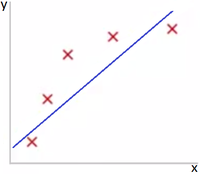

Представьте задачу предсказания y по x ∈ R. Рис 1 показывает результат использования модели для представленного датасета. Как видно из Рис 1 данные не поддаются линейной зависимости и по этой причине модель не очень хороша.

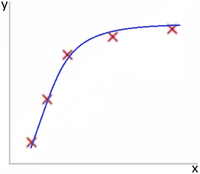

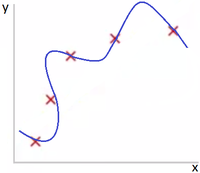

Если же добавить дополнительный параметр x^2, и использовать модель , как представлено на Рис 2, то модель значительно лучше подходит для представленного датасета. Рис 3 показывает результат использования модели для представленного датасета. Как видно из Рис 3 данная модель слишком заточена для обучающего датасета и, веротяно, покажет плохой результат на тестовой.

На примере логистической регрессии

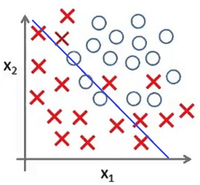

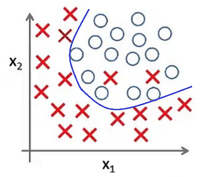

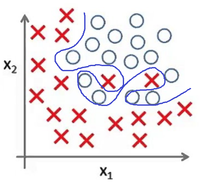

Представьте задачу классификации размеченых точек. Рис 4 показывает результат использования модели для представленного датасета. Как и в предыдущем примере, данные не поддаются классификации по линейной зависимости.

В случае же выбора модели , представленой на Рис 5, данные значительно лучше соответствуют модели. Рис 6 показывает результат использования модели для представленного датасета - это яркий пример явления переобучения.

Кривые обучения

Кривые обучения при переобучении

Кривые обучения при недообучении

Возможные решения

Возможные решения при переобучении

- Увеличение данных датасета

- Уменьшение количества параметров

- Добавление регуляризации / увеличение коэффициента регуляризации

Возможные решения при недообучении

- Добавление новых параметров

- Использование для описания модели функций с более высокой степенью

- Уменьшение коэффициента регуляризации

См. также

- Модель алгоритма и ее выбор[на 01.12.18 не создан]

- Оценка качества в задачах классификации и регрессии [на 01.12.18 не создан]

- Оценка качества в задаче кластеризации [на 01.12.18 не создан]

Примечания

- Overfitting: when accuracy measure goes wrong

- The Problem of Overfitting Data

- Overfitting in Machine Learning

Источники информации

- Overfitting - статься на Википедии

- Переобучение - вводная статься на MachineLearning.ru

- The Problem of Overfitting - курс Andrew Ng