Машинное обучение на мобильных телефонах

Машинное обучение, как известно, очень тесно связано с нашей жизнью. Конечно же, модели нужно где-то запускать и сохранять. Самый простой выход из ситуации — сервер, на котором будет находиться наша модель, и который будет принимать запросы. Однако, что, если мы находимся в глухом лесу и у нас нет доступа к Интернету? Что, если мы не хотим хранить свои данные на чужих серверах? У нас нет своих серверов для машинного обучения, но мобильные телефоны есть почти у каждого. Давайте рассмотрим машинное обучение на телефонах.

Задачи машинного обучения на телефонах

Кастомизация

Конечно же, самое первое, что может прийти в голову про применение машинного обучения на телефонах — это кастомизация. Подбор музыки, новостей, любого контента — все это достигается с помощью машинного обучения. Приложение получает ваши персональные данные и, используя данные старых пользователей, показывает вам то, что понравилось людям с наиболее подходящими данными. Однако такая работа связана с очень большими вычислениями, и, чаще всего, выполняется на сторонних серверах. Самая частая модель для классификации изображений — CNN, однако порой такая классификация является излишней.

Пример приложения:

- Spotify

- TikTok

Распознавание фото, текста и видео

Распознавание фото и видео на мобильных телефонах мало чем отличается от обычных компьютерных методов, только цели немного другие. Например, некоторые мобильные телефоны распознают владельца через Face ID с помощью фронтальной камеры. Есть приложения для определения возраста, пола.

Если же рассмотреть распознавание текста, то и у него тоже есть большое количество применений — сканирование чеков, кредитные карты, документы, переводить в реальном времени иностранные слова.

Существует несколько известных библиотек для работы с изображениями в мобильных приложениях: Tesseract[1], OpenCV[2], Mobile Vision Google[3], ML Kit[4]. Изображения легко передавать через сеть, так что можно обрабатывать их и на веб-серверах.

Распознавание звука

Распознавание звука и его парсинг тоже очень важная задача машинного обучения. Голосовые помощники, голосовой ввод, умные дома — все это нужно для нашей жизни.

Для распознавания речи есть библиотека pocketsphinx[5]

Анализ данных с сенсоров

| Приложение | Датчик |

|---|---|

| Распознавание человеческой активности | Акселерометр |

| Гироскоп | |

| Магнитометр | |

| Монитор сердечного ритма | |

| Распознавание жестов | Акселерометр |

| Гироскоп | |

| Распознавание падений | Акселерометр |

| Гироскоп | |

| Датчики близости | |

| Распознавание аварий | Акселерометр |

| Приемник GPS | |

| Распознавание условий окружающей среды | Датчик окружающего света |

| Датчик влажности | |

| Термометр | |

| Датчик давления | |

| Приемник GPS | |

| Распознавание стресса | Микрофон |

| Электрокардиограф | |

| Монитор сердечного ритма | |

| Датчик проводимости кожи | |

| Распознавание эмоций | Микрофон |

| Камера | |

| Электрокардиограф | |

| Монитор сердечного ритма | |

| Датчик проводимости кожи |

Телефон получает данные об окружающем мире с помощью специальных датчиков и сенсоров. В мире их существует огромное количество, и, к сожалению, большинство из них работает недостаточно точно. Но это исправляет машинное обучение, уточняя данные с сенсоров. Это важно для людей с опасными для жизни болезнями, например, может произойти сердечный приступ, и процессор лучше любого человека скажет, что это он, и, считав местоположение с навигатора, вызовет скорую помощь в тот же момент.

Навигация

Навигационные приложения можно значительно улучшить, если интегрировать в них алгоритмы по распознаванию фото и видео. К примеру, если приложение подключается к камере в автомобиле, оно может анализировать ситуацию на дороге и предупреждать водителя в случае возможной опасности. Так можно распознавать пробки, дорожные знаки по ограничению скорости, агрессивное поведение окружающих водителей и другие характеристики дорожного движения.

Запуск моделей машинного обучения на мобильных телефонах

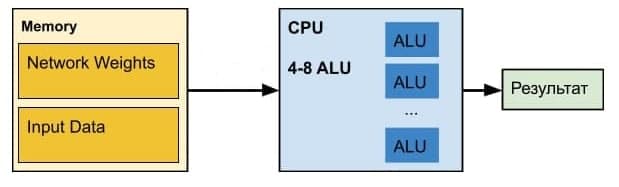

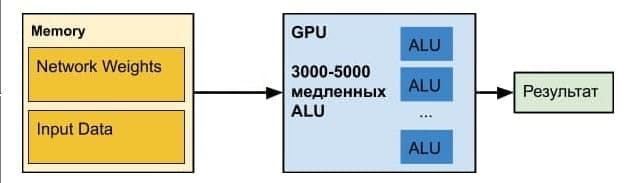

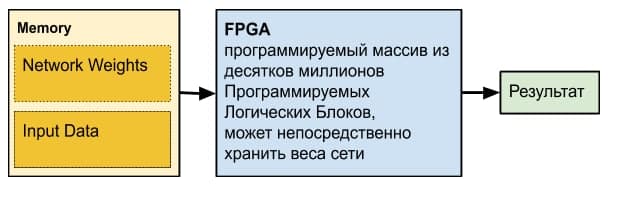

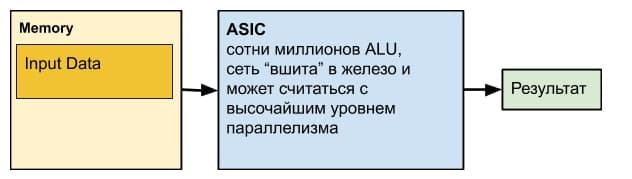

Для запуска глубоких моделей необходимо наличием мощных вычислительных ресурсов и большого объема учебных данных. Поэтому построение модели может осуществляться с помощью высокопроизводительных центральных (англ. central processing unit, CPU[6]) и графических (англ. graphics processing unit, GPU[7]) процессоров, а после построения ее можно запустить на мобильном устройстве с гораздо меньшей вычислительной мощностью на CPU, интегральных схемах специального назначения (англ. Application specific integrated circuit, ASIC), программируемых пользователем вентильных матриц (англ. Field programmable gate array, FPGA) или мобильных GPU. На рисунках 1-4 представлены модели взаимодействия с соответcтвующими вычислительными устройствами.

CPU

Хотя процессоры могут быть громоздкими для построения современных моделей глубокого обучения, когда учебные данные очень большие, они являются приемлемым вариантом для обучения или адаптации моделей к небольшим объемам данных, а также для развертывания предварительно построенных моделей глубокого обучения. Очевидным преимуществом развертывания глубокого обучения на CPU является то, в отличие от других типов вычислительных устройств ими оснащен любой современный телефон или планшет. Кроме того, мобильный устройства часто поставляются с мощными процессорами и имеют широкий выбор встроенных датчиков. Это означает отсутствие дополнительных затрат на аппаратное обеспечение и таким образом обеспечение большего количества приложений ИИ для потенциально огромного рынка. Real-time приложения могут быть развернуты на стандартном процессоре с минимальными затратами или без дополнительных усилий. Кроме того CPU в современных мобильных устройвах столь же мощны как и в компьютерах, что позволяет эффективно использовать их для данных целей.

GPU

GPU — графический процессор, который по своему устройству является процессором с несколькими тысячами маленьких ядер. За счет этого достигается большая степень параллельности, что позволяет производить на GPU более эффективные вычисления с матрицами и тензорами, нежели на CPU. На данный момент существует множество мобильных GPU от разных производителей, например одной из самых заметных систем смартфонов на чипе (SoC) является чип Qualcomm Snapdragon.

FPGA

В то время как CPU создан для вычислений общего назначения, а ASIC сделана исключительно для специфических вычислений, FPGA находится между ними. FPGA могут быть (повторно) запрограммированы ("перепрошиты") для эффективного выполнения многих специфических задач. На базовом уровне FPGA используют схемы flip-flop для реализации последовательных логических функций и поиска таблиц. Логические функции реализуются посредством программируемой памяти, которая также контролирует соединения коммутационных цепей, таким образом, FPGA не нужно явно выполнять логическую операцию после того, как она запрограммирована. Современные FPGA, как правило, используют SoC подход для интеграции ядра процесса, коммуникационного ядра, и память на одной микросхеме. FPGA вендоры, такие как Xilinx и Altera, создали множество программного обеспечения для облегчения программирования на FPGA. В то время как традиционное программирование для FPGA требует знаний о цифровых схемах и языка описания оборудования (HDL), сейчас оно движется в сторону создания схем высокого уровня (HLS). Существует пять основных категорий инструментов HLS, но для мобильного глубокого обучения наиболее актуален фреймворк параллельных вычислений OpenCL. OpenCL — это язык основанный на C и являющийся открытой, стандартизированной основой для ускорения алгоритмов. Программы, написанные на OpenCL, могут быть выполнены на GPU, DSP и FPGA. OpenCL можно рассматривать как open source версию CUDA.

ASIC и TPU

ASIC — интегральная схема конкретно под поставленную задачу. Примером можем служить интегральная схема реализующая необходимую нейросеть. За счёт этого, энергопотребление становится меньше, а скорость работы операций выше по сравнению с CPU, GPU и FPGA. Также, большинство вычислительных узлов может работать параллельно, только зависимости по данным и неравномерность вычислений на разных уровнях сети могут помешать постоянно задействовать все ALU. Самым большим недостатком является потеря настраиваемости сети, так как настрока параметров будет связана с изменением интегральной схемы. На текущее время, существует множество ASIC, разработанных для нейронных сетей, например TPU разработанная Google специально для нейросетевого машинного обучения.

Сравнение

Как упоминалось в предыдущих подразделах, CPU и GPU являются вычислительными платформами общего назначения, предлагая таким образом большую гибкость. Начальное алгоритмическое обучение модели должно использовать CPU и GPU для получения предварительного представления о достижимой производительности. CPU и GPU поддерживают вычисления с полной точностью и могут быть использованы для моделей с интенсивными вычислениями, что часто означает более высокую точность прогнозирования. Однако, GPU и CPU более энергозатратны. ASIC могут быть гораздо более энергоэффективными, так как аппаратное обеспечение изготовлено специально для некоторых вычислений. Тем не менее, проектирование и разработка микросхем ASIC может занять очень много времени. Таким образом, ASIC используется только тогда, когда модель фиксирована и требуются низкие затраты энергии. FPGA предлагает компромисс между энергопотреблением, точностью прогнозирования и скоростью разработки системы.

Вес современных нейронных сетей

В нынешних реалиях глубокие нейронные сети могут весить порядка сотен мегабайт, в то же время современные фреймворки например MobileNet позволяют строить нейросети значительно меньшего размера при небольшой потере точности, такие сети отлично подходят для мобильных устройств. Результаты использования MobileNet приведены в сравнении с другими нейросетями приведены в таблице ниже.

| model | input size | param memory | future memory |

|---|---|---|---|

| rfcn-res50-pascal | 600 x 850 | 122 MB | 1 GB |

| rfcn-res101-pascal | 600 x 850 | 194 MB | 2 GB |

| ssd-pascal-vggvd-300 | 300 x 300 | 100 MB | 116 MB |

| ssd-pascal-vggvd-512 | 512 x 512 | 104 MB | 337 MB |

| ssd-pascal-mobilenet-ft | 300 x 300 | 22 MB | 37 MB |

| aster-rcnn-vggvd-pascal | 600 x 850 | 523 MB | 600 MB |

Процессоры

Из-за медлительности телефонов развитие машинного обучения на них началось совсем недавно. Раньше все данные хранились на серверах компаний, выбор модели был очень широк, и, с точки зрения безопасности, это было плохо. Однако теперь IT-гиганты, такие, как Google, переходят на модель федеративного обучения[8]. Понятно, что обычный телефон не может себе позволить обучаться на моделях, которые потребляют много ресурсов, таких как, например, нейронные сети. Однако существуют модели, которые потребляют очень малое количество памяти и времени на обучение. В основном именно они используются, когда нет соединения с сервером.

Однако машинное обучение стало настолько актуальным, что производители процессоров задумались о том, что бы создавать процессоры, некоторые чипы которых заточены под задачи машинного обучения.

Существует огромное число процессоров для огромного числа задач, начиная от задачи линейной регрессии до задач глубокого обучения.

Вот примеры таких процессоров — Qualcomm Neural Processing SDK[9], Huawei Ai[10], NeuroPilot SDK[11], CoreML SDK[12]

Qualcomm Neural Processing SDK

Этот процессор заточен под работу с аудио и видео: распознавание речи, обработку изображений, очистку картинки от шума и подобное.

| Область применения | Пример использования |

|---|---|

| Генератор текста | Преобразование данных в текст |

| Распознавание речи | Голосовые системы |

| Чат-боты | Программы, способные общаться с людьми |

| Биометрика | Идентификация и анализ здоровья людей |

| Обработка естественного языка | Понимание структуры и значения фраз |

| Распознавание эмоций | Считывание информации с лица |

| Распознавание изображений | Подсчет числа обьектов на картинке |

Разработчики данного процессора делают упор на сверточные сети, однако там встречаются почти все известные модели машинного обучения. Обеспечивает аппаратное ускорение ML-моделей на связке DSP + GPU + CPU для Snapdragon чипов. Далее приведен листинг на языке C++, который принимает на берет объект класса модели Snapdragon Neural Processing Engine (SNPE), преобразует их в модель и сохраняет их в файл:

#include "zdl.h"

void executeNetwork(std::unique_ptr<zdl::SNPE::SNPE>& snpe,

std::unique_ptr<zdl::DlSystem::ITensor>& input,

std::string OutputDir,

int num)

{

static zdl::DlSystem::TensorMap outputTensorMap;

snpe->execute(input.get(), outputTensorMap);

zdl::DlSystem::StringList tensorNames = outputTensorMap.getTensorNames();

//Проходимся по всем объектам и выводим их имена

std::for_each( tensorNames.begin(), tensorNames.end(), [&](const char* name)

{

std::ostringstream path;

path << OutputDir << "/"

<< "Result_" << num << "/"

<< name << ".raw";

auto tensorPtr = outputTensorMap.getTensor(name);

SaveITensor(path.str(), tensorPtr);

});

}

void SaveITensor(const std::string& path, const zdl::DlSystem::ITensor* tensor)

{

...

std::ofstream os(path, std::ofstream::binary);

if (!os)

{

std::cerr << "Failed to open output file for writing: " << path << "\n";

std::exit(EXIT_FAILURE);

}

for ( auto it = tensor->cbegin(); it != tensor->cend(); ++it )

{

float f = *it;

if (!os.write(reinterpret_cast<char*>(&f), sizeof(float)))

{

std::cerr << "Failed to write data to: " << path << "\n";

std::exit(EXIT_FAILURE);

}

}

}

Huawei Ai

Этот процессор заточен под компьютерное зрение, распознавание речи и интерпретацию естественного языка.

Как можно заметить по картинке, здесь нет никакого обучения, мы берем уже обученную модель и пользуемся ею. Огромное количество классов, предназначенных для различных задач. HiAI SDK дает доступ к заточенному под операции над матрицами NPU. Таким образом, оптимизируются нейронные сети, которые используют матрицы.

Пример кода на Java, распознающего, одинаковые ли люди изображены на картинке.

import com.huawei.hiai.vision.face.FaceComparator;// Класс для сравнивания лиц

import com.huawei.hiai.vision.visionkit.face.FaceCompareResult;// Класс результата сравнивания лиц

if (!AiEngineMgr.isAsync) {

resultCode = mFaceComparator.faceCompare(image1, image2, mFaceCompareResult, null);

} else {

mFaceComparator.faceCompare(image1, image2, null,

new VisionCallback<FaceCompareResult>() {

@Override

public void onResult(FaceCompareResult faceCompareResult){

mFaceCompareResult = faceCompareResult;

resultCode = 0;

}

@Override

public void onError(int i){

resultCode = i;

HopeCVLog.d(temp_Log,"onError: "+i);

}

@Override

public void onProcessing(float v){

}

});

}

try {

Float confidence = mFaceCompareResult.isSamePerson();

boolean samePerson = mFaceCompareResult.getSocre();

} catch (Exception e) {

e.printStackTrace();

}

NeuroPilot SDK

Процессор заточен под отслеживание поз множества людей, идентификацию множества объектов, семантическую сегментацию, обработку изображений. NeuroPilot SDK позволяет решать ML-задачи с помощью APU + GPU. APU заточен под модели глубоких нейронных сетей. Обеспечивает аппаратное ускорение для свертки, полносвязных нейронных сетей (то есть нейронных сетей без дропаута), функции активации.

У данной разработки есть три пути развития:

- чип NeuroPilot Micro, представляющий собой микрокомпьютер, оптимизированный под задачи машинного обучения. Его возможности ограничены $10^6$ операциями, мегабайтами памяти. В качестве такого чипа так же можно использовать обычные схематические конструкторы, такие как Arduino[13] (конечно же, их скорость будет ниже на порядок).

- телефон или телефонный чип, на который загружено специальное ПО. Возможности ограничены примерно $10^8 - 10^9$ операциями и гигабайтами памяти.

- удаленное серверное управление. По словам авторов, количество операций и памяти почти безграничны.

В своем основании использует TFLite модели, лучше всего подходит TensorFlow и Keras. Можно писать программы прямо на нем, они будут успешно оптимизироваться.

CoreML SDK

Создан для классификации объектов, звуков, движений, текста, табличных данных, обладает рекомендательной системой. Работает на NPU. Пример использования для картинок.

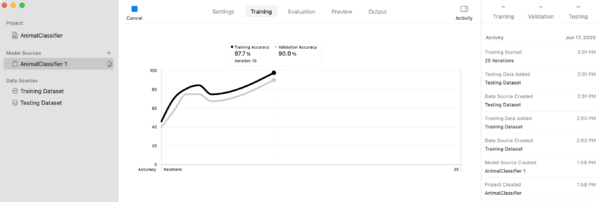

Данное программное обеспечение сильно разделено. У нас есть специальная MLModel, которая изначально принимает изображения, и сохраняет их в компактном виде, сохраняя там же уже натренированную сеть (см. рисунок 5). Затем данный пакет передается уже программе, и она обрабатывает его. Пример кода на Swift:

import UIKit

import CoreML

import Vision

import ImageIO

DispatchQueue.main.async {

guard let results = request.results else {

self.classificationLabel.text = "Unable to classify image.\n\(error!.localizedDescription)"

return

}

let classifications = results as! [VNClassificationObservation]

if classifications.isEmpty {

self.classificationLabel.text = "Nothing recognized."

} else {

// Display top classifications ranked by confidence in the UI.

let topClassifications = classifications.prefix(2)

let descriptions = topClassifications.map { classification in

// Formats the classification for display; e.g. "(0.37) cliff, drop, drop-off".

return String(format: " (%.2f) %@", classification.confidence, classification.identifier)

}

self.classificationLabel.text = "Classification:\n" + descriptions.joined(separator: "\n")

}

}

Для работы с кодом и результатами у Apple есть рекомендуется программа XCode (пример работы см. рисунок 6)

См. также

Примечания

Источники информации

- azoft.ru - о применении машинного обучения.

- habr.com - железо и процессоры.

- researchgate.net - Deep Learning on Mobile Devices, Yunbin Deng

- habr.com - аппаратное ускорение нейронных сетей

- habr.com - краткий обзор и пример на CoreML.

- habr.com - распознавание изображений.

- habr.com - использование ML Kit.

- habr.com - использование Pocketsphinx.

- osp.ru - глубинный анализ данных с сенсоров.